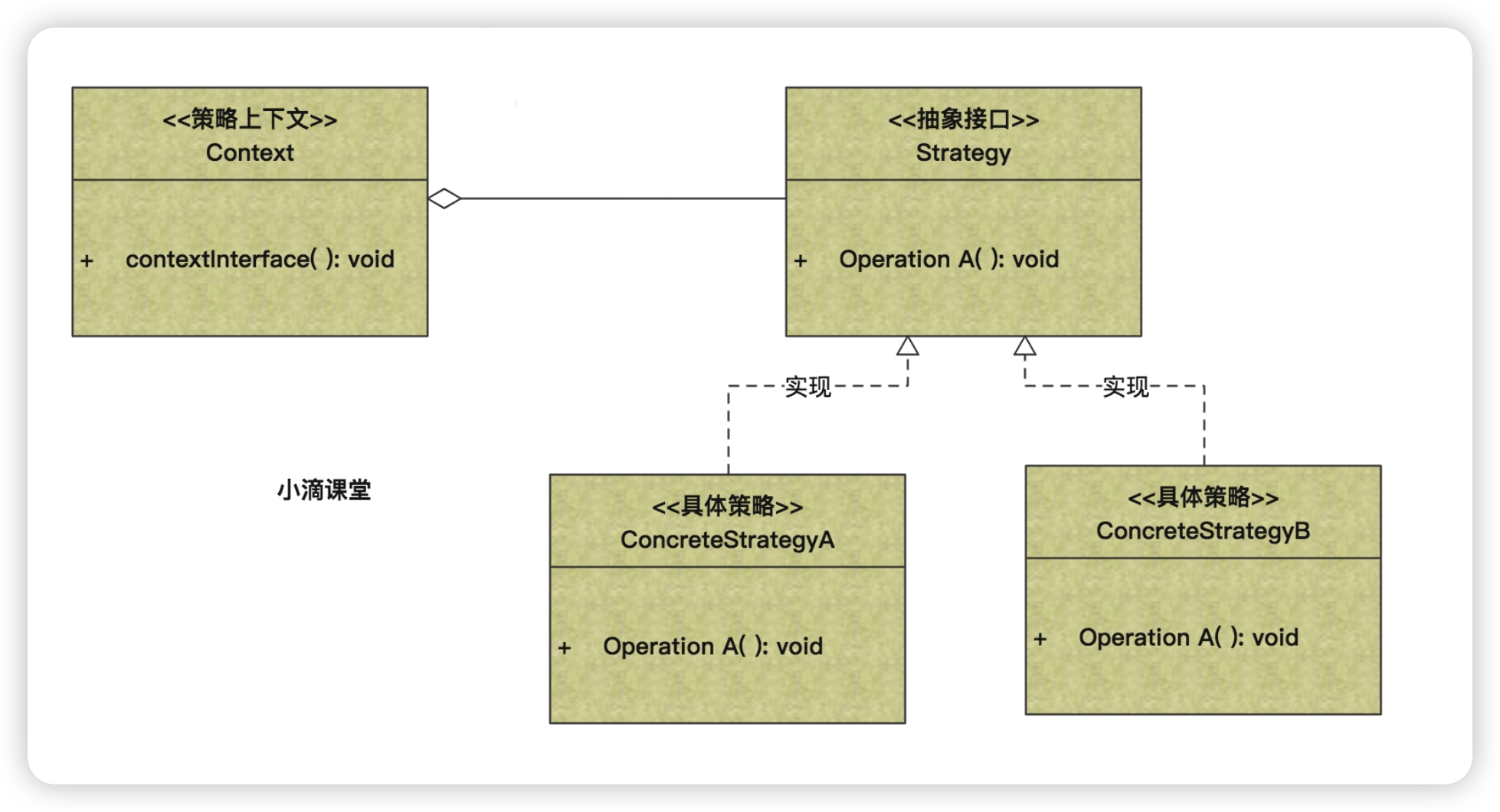

* 应用场景

- 外出旅游,选择骑自行车、坐汽车、飞机等,每一种旅行方式都是一个策略

- 如果在一个系统里面有许多类,它们之间的区别仅在于它们的行为,那么可以使用策略模式

- 不希望暴露复杂的、与算法有关的数据结构,那么可以使用策略模式来封装算法

* 为什么要抽象存储引擎接口

* 将文件存储引擎的接口抽象出来,具体实现可以多种,提高系统的灵活性和可维护性。

* 允许我们根据不同的需求和环境(如开发、测试、生产)灵活切换不同的存储解决方案

* 优点

- **灵活性和可扩展性**:通过定义一个统一的存储接口,我们可以在不修改客户端代码的情况下引入新的存储解决方案。

- **解耦**:将存储逻辑从业务逻辑中解耦,使得存储引擎的变化不影响业务逻辑。

- **易于测试**:可以针对接口编写单元测试,而不必依赖具体的存储实现。

- **代码复用**:多个项目可以共享相同的存储接口,提高代码复用率。

- **简化维护**:统一的接口使得维护和更新存储逻辑变得更加简单。

* 缺点

- **复杂性增加**:需要额外定义接口和可能的抽象类,增加了系统的复杂性。

- **性能考虑**:接口调用可能引入额外的性能开销,尤其是在接口频繁调用的情况下。

- **实现一致性**:确保所有存储策略实现都遵循相同的接口规范,需要严格的代码审查和测试。

* 注意

* **其实aws-java-sdk-s3本身就是封装好了,支持多个存储的,为啥我们又要加一层呢???**

* 假想下

* 万一我以后不用aws-java-sdk-s3,那岂不是四处要修改aws-java-sdk-s3的API方法

* 但如果我加了一层,其他地方使用的话,后续修改换别的SDK,我只需要修改我自己封装的那层即可

#### SpringBoot3.X整合MinIO存储AWS-S3封装

封装存储引擎接口设计【常规版】

* * 定义一个名为StorageEngine的接口,包含多个方法

* 可以跟进需求,实现`StorageEngine`接口的不同存储策略

- **LocalFileStorageEngine**:使用本地文件系统作为存储。

- **S3StorageEngine**:使用Amazon S3作为存储。

- **DatabaseStorageEngine**:使用数据库存储文件元数据和内容。

- **MinIOStorageEngine**:使用MinIO存储文件内容。

- ...

* 使用策略模式的优势

- **客户端代码与存储实现解耦**:客户端代码只需与`StorageEngine`接口交互,不需要关心具体的存储细节。

- **易于切换存储策略**:根据不同的业务需求或环境(开发、测试、生产)灵活切换不同的存储策略。

- **支持A/B测试**:可以同时运行多个存储策略,进行性能和效果比较。

* 抽取文件操作相关接口 StoreEngine

```java

public interface StoreEngine {

/*=====================Bucket相关===========================*/

/**

* 检查指定的存储桶是否存在于当前的存储系统中

*

* @param bucketName 存储桶的名称

* @return 如果存储桶存在,则返回true;否则返回false

*/

boolean bucketExists(String bucketName);

/**

* 删除指定名称的存储桶

*

* @param bucketName 存储桶的名称

* @return 如果存储桶删除成功,则返回true;否则返回false

*/

boolean removeBucket(String bucketName);

/**

* 创建一个新的存储桶

*

* @param bucketName 新存储桶的名称

*/

void createBucket(String bucketName);

/**

* 获取当前存储系统中的所有存储桶列表

*

* @return 包含所有存储桶的列表

*/

List

* 应用场景

- 外出旅游,选择骑自行车、坐汽车、飞机等,每一种旅行方式都是一个策略

- 如果在一个系统里面有许多类,它们之间的区别仅在于它们的行为,那么可以使用策略模式

- 不希望暴露复杂的、与算法有关的数据结构,那么可以使用策略模式来封装算法

* 为什么要抽象存储引擎接口

* 将文件存储引擎的接口抽象出来,具体实现可以多种,提高系统的灵活性和可维护性。

* 允许我们根据不同的需求和环境(如开发、测试、生产)灵活切换不同的存储解决方案

* 优点

- **灵活性和可扩展性**:通过定义一个统一的存储接口,我们可以在不修改客户端代码的情况下引入新的存储解决方案。

- **解耦**:将存储逻辑从业务逻辑中解耦,使得存储引擎的变化不影响业务逻辑。

- **易于测试**:可以针对接口编写单元测试,而不必依赖具体的存储实现。

- **代码复用**:多个项目可以共享相同的存储接口,提高代码复用率。

- **简化维护**:统一的接口使得维护和更新存储逻辑变得更加简单。

* 缺点

- **复杂性增加**:需要额外定义接口和可能的抽象类,增加了系统的复杂性。

- **性能考虑**:接口调用可能引入额外的性能开销,尤其是在接口频繁调用的情况下。

- **实现一致性**:确保所有存储策略实现都遵循相同的接口规范,需要严格的代码审查和测试。

* 注意

* **其实aws-java-sdk-s3本身就是封装好了,支持多个存储的,为啥我们又要加一层呢???**

* 假想下

* 万一我以后不用aws-java-sdk-s3,那岂不是四处要修改aws-java-sdk-s3的API方法

* 但如果我加了一层,其他地方使用的话,后续修改换别的SDK,我只需要修改我自己封装的那层即可

#### SpringBoot3.X整合MinIO存储AWS-S3封装

封装存储引擎接口设计【常规版】

* * 定义一个名为StorageEngine的接口,包含多个方法

* 可以跟进需求,实现`StorageEngine`接口的不同存储策略

- **LocalFileStorageEngine**:使用本地文件系统作为存储。

- **S3StorageEngine**:使用Amazon S3作为存储。

- **DatabaseStorageEngine**:使用数据库存储文件元数据和内容。

- **MinIOStorageEngine**:使用MinIO存储文件内容。

- ...

* 使用策略模式的优势

- **客户端代码与存储实现解耦**:客户端代码只需与`StorageEngine`接口交互,不需要关心具体的存储细节。

- **易于切换存储策略**:根据不同的业务需求或环境(开发、测试、生产)灵活切换不同的存储策略。

- **支持A/B测试**:可以同时运行多个存储策略,进行性能和效果比较。

* 抽取文件操作相关接口 StoreEngine

```java

public interface StoreEngine {

/*=====================Bucket相关===========================*/

/**

* 检查指定的存储桶是否存在于当前的存储系统中

*

* @param bucketName 存储桶的名称

* @return 如果存储桶存在,则返回true;否则返回false

*/

boolean bucketExists(String bucketName);

/**

* 删除指定名称的存储桶

*

* @param bucketName 存储桶的名称

* @return 如果存储桶删除成功,则返回true;否则返回false

*/

boolean removeBucket(String bucketName);

/**

* 创建一个新的存储桶

*

* @param bucketName 新存储桶的名称

*/

void createBucket(String bucketName);

/**

* 获取当前存储系统中的所有存储桶列表

*

* @return 包含所有存储桶的列表

*/

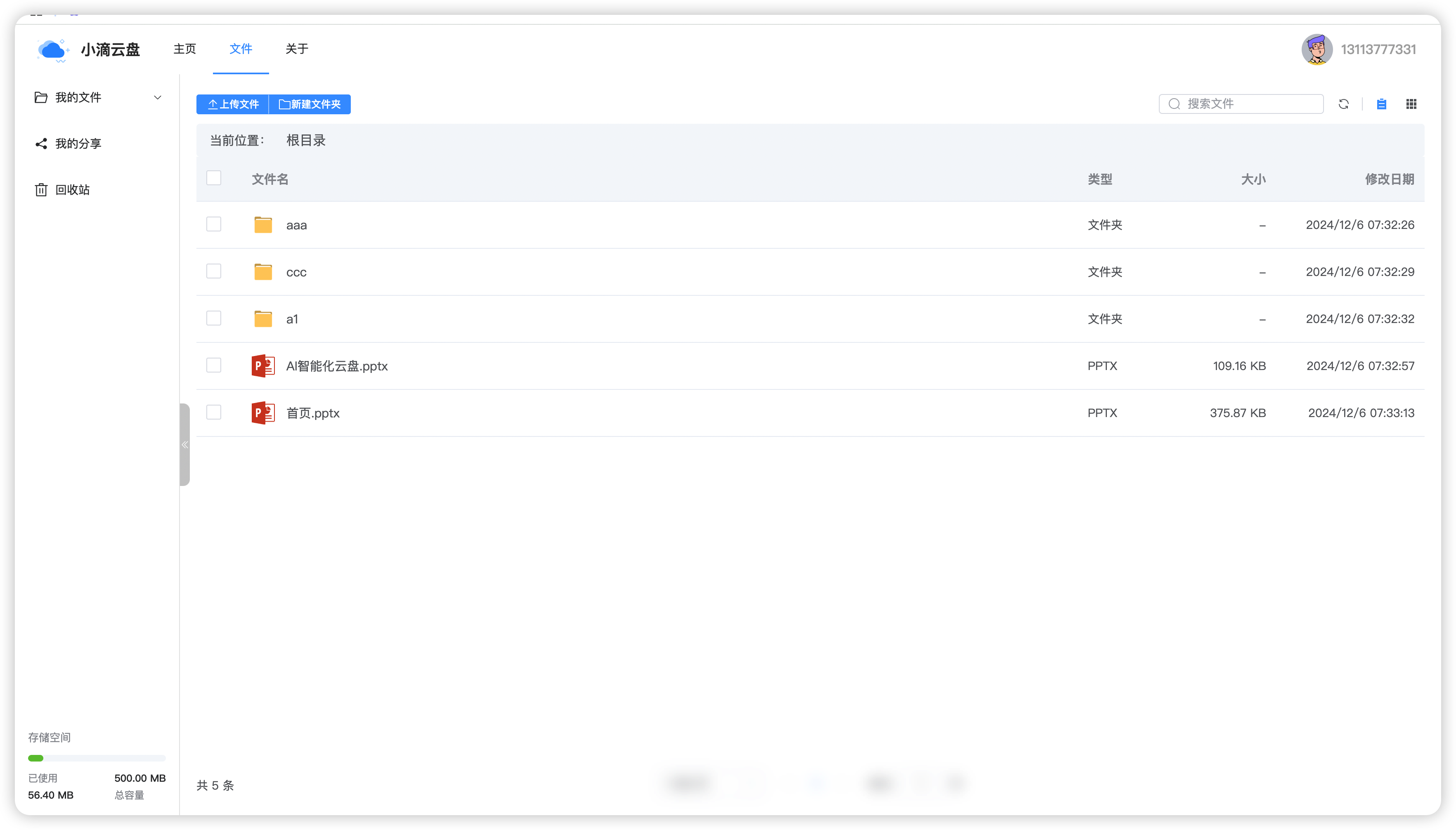

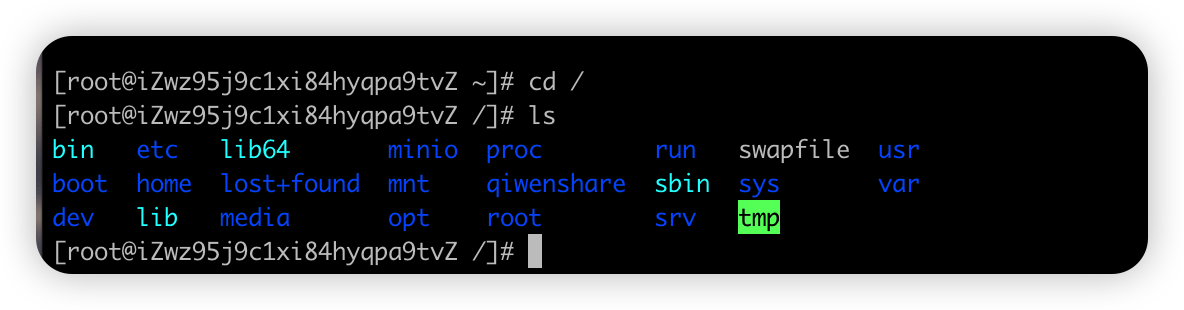

List * 智能云盘

* 智能云盘

* 云盘存储相关设计说明

* 任何文件都有一个唯一标识,我们统一命名为 **identifier**,同个文件产生的标识是不变的

* 唯一标识(identifier)可以采用多个方案,也有对应的类库

* 哈希函数(如MD5、SHA-256)

* 优点:

* 唯一性:理论上 不同的文件内容会产生不同的哈希值,保证了标识的唯一性。

* 快速计算:哈希函数可以快速计算出文件的哈希值。

* 安全性:对于SHA-256等哈希算法,抗碰撞性较强,不易被篡改。

* 缺点:

* 安全性问题:对于MD5,由于其抗碰撞性较弱,已经不推荐用于安全敏感的应用。

* 存储和比较:哈希值需要存储和比较,对于非常大的文件系统,这可能会增加存储和计算开销。

* 基于内容的指纹(如SimHash、Locality-Sensitive Hashing)

* 优点:

* 相似性检测:适用于检测相似或重复的文件,可以容忍文件内容的微小变化。

* 减少存储:通过减少哈希值的位数来减少存储需求。

* 缺点:

* 计算复杂性:相比于简单的哈希函数,这些算法可能需要更复杂的计算。

* 误判率:在某些情况下可能会有误判,即不同的文件产生相同的指纹。

* 文件元数据组合

* 优点:

* 简单易实现:通过文件的大小、创建时间、修改时间等元数据生成标识。

* 快速检索:基于元数据的检索通常很快。

* 缺点:

* 非唯一性:不同的文件可能具有相同的元数据,特别是在文件被复制或修改的情况下。

* 不稳定性:文件的元数据(如修改时间)可能会改变,导致标识失效

* 方案:采用MD5, 相关标识可以前端和后端保持一定规则,前端上传的时候生成标识传递给后端

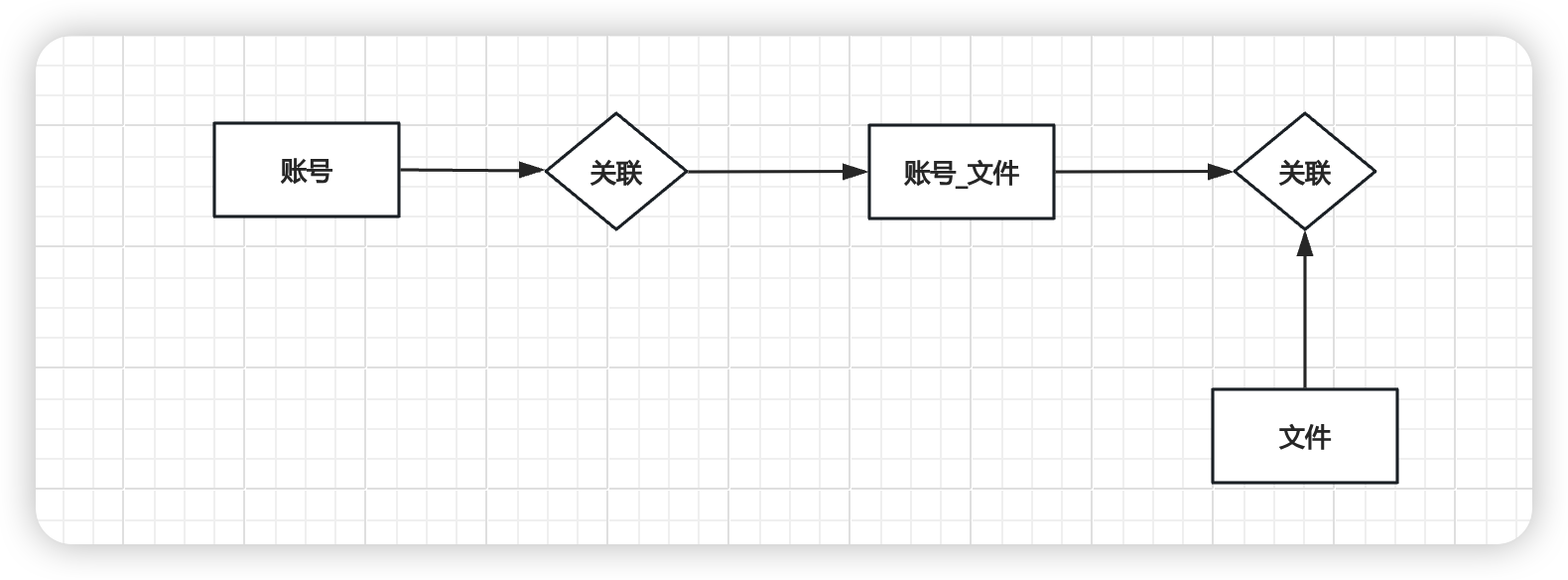

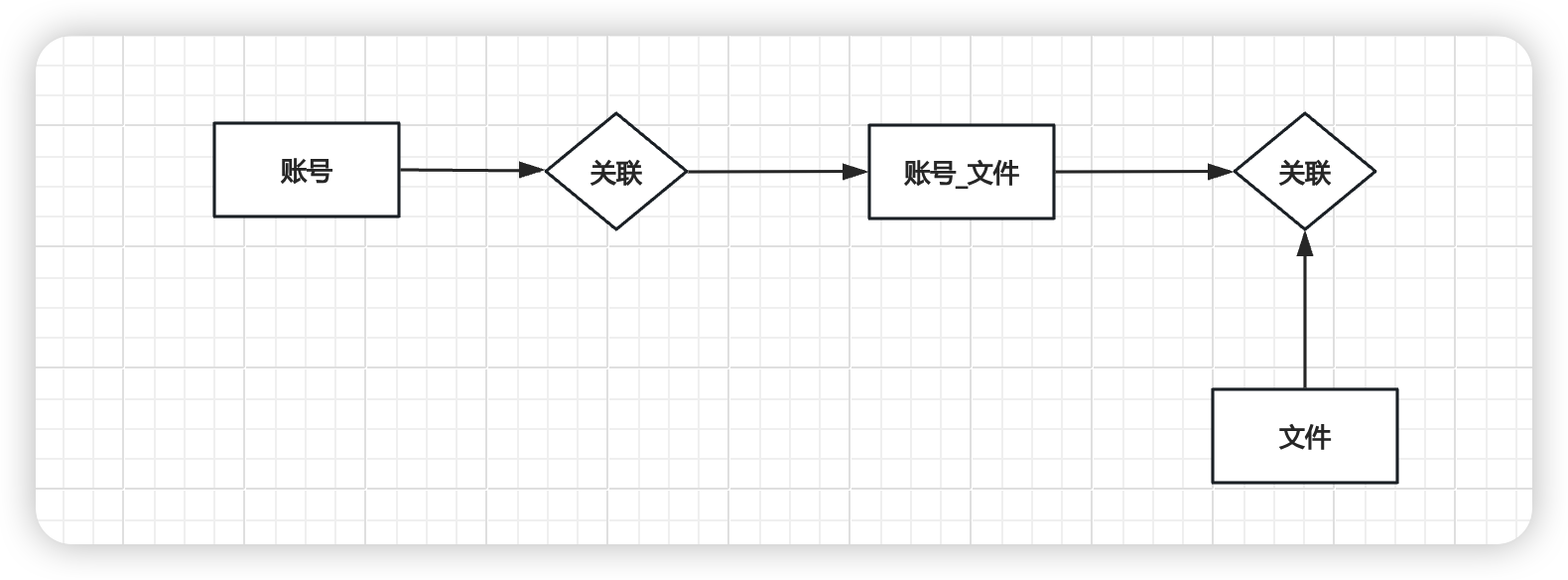

#### 账号表-文件表和关联关系表设计说明

* 三个关键表说明

* **account表**:存储用户的基本信息,如用户名、密码、头像等。这是用户身份验证和个性化设置的基础。

* **file表**:存储文件的元数据,包括文件名、大小、后缀、唯一标识符(MD5)等。主要用于跟踪文件的属性和文件的唯一性

* **account_file表**:

* 存储用户与文件之间的关系,包括文件的层级结构(文件夹和子文件),以及文件的类型和大小等信息。

* 这个表允许一个用户有多个子文件和文件夹,并且可以表示文件的层级关系

* 如果没有`account_file`表,

* 每个用户都重复上传,随着文件数量的增加,没有`account_file`表来组织文件结构,`file`表会变得非常大,性能问题

* 无法有效地表示文件和文件夹的层级结构

* 实现文件的移动、复制、删除等操作会变得复杂,因为没有一个明确的结构来跟踪文件的层级和用户关系

* 权限管理也会变得更加复杂,因为没有一个清晰的结构来定义哪些文件可以被哪些用户访问。

* 智能化云盘设计的3个表理解清楚

* 账号表

* 记录账号相关基础信息

* 关键字段

```

id 即后续用的 account_id

username

password

role 用户角色 COMMON, ADMIN

```

* 账号文件关系表

* 记录对应账号下的文件和文件夹、关系等

* 关键字段

```

id

account_id 账号ID

is_dir 是否是目录,0不是文件夹,1是文件夹

parent_id 上层文件夹ID,顶层文件夹为0

file_id 文件ID,真正存储的文件

file_name 文件名和实际存储的文件名区分开来,可能重命名

```

* 文件表

* 记录文件相关的物理存储信息

```

id 即file_id

account_id 哪个账号上传的

file_name 文件名

object_key 文件的key, 格式 日期/md5.拓展名,比如 2024/11/13/921674fd-cdaf-459a-be7b-109469e7050d.png

identifier 唯一标识,文件MD5

```

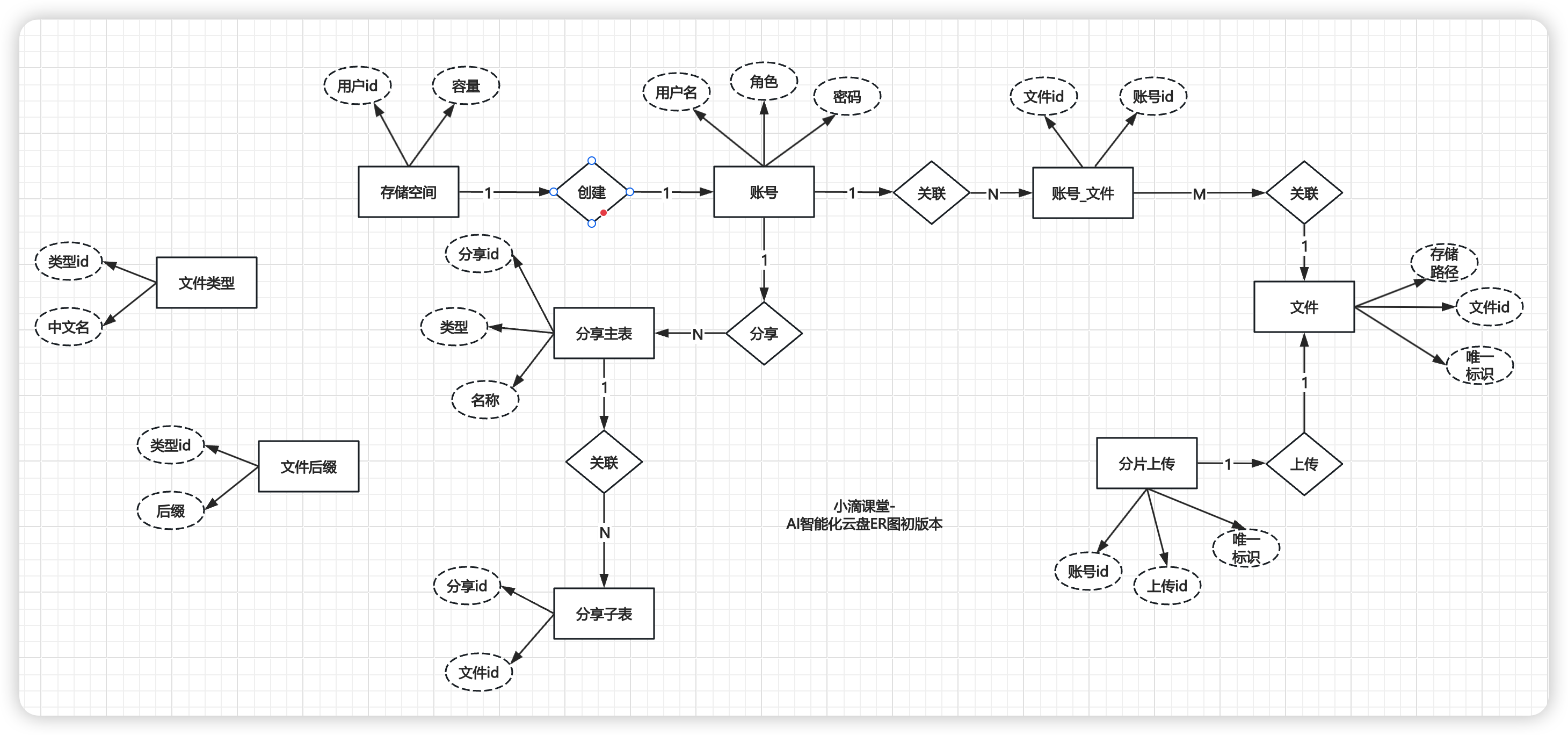

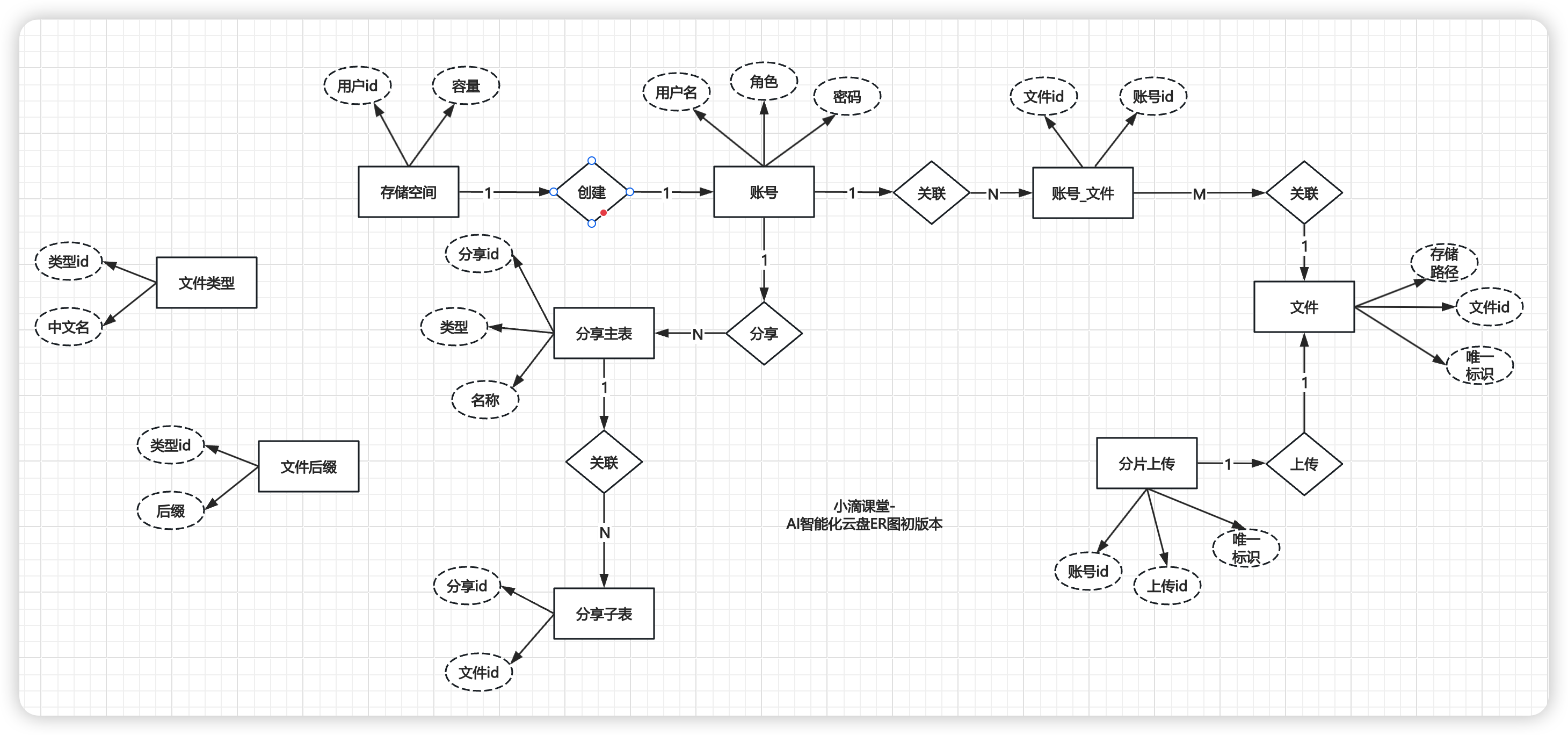

#### AI智能化云盘数据库设计和字段说明

* 数据库ER图设计(**后续还有调整相关表结构**)

* 导入建表语句

#### 智能化云盘数据库逆向工程配置生成

* 配置数据库

```java

public class MyBatisPlusGenerator {

public static void main(String[] args) {

String userName = "root";

String password = "xx";

String serverInfo = "127.0.0.1:3306";

String targetModuleNamePath = "/";

String dbName = "ycloud-aipan";

String[] tables = {

"account", "file","account_file","file_chunk", "file_suffix","file_type", "share", "share_file", "storage"

};

// 使用 FastAutoGenerator 快速配置代码生成器

FastAutoGenerator.create("jdbc:mysql://"+serverInfo+"/"+dbName+"?useUnicode=true&characterEncoding=utf-8&useSSL=false&serverTimezone=Asia/Shanghai&tinyInt1isBit=true", userName, password)

.globalConfig(builder -> {

builder.author("everyone") // 设置作者

.commentDate("yyyy-MM-dd")

.enableSpringdoc()

.disableOpenDir() //禁止打开输出目录

.dateType(DateType.ONLY_DATE) //定义生成的实体类中日期类型 DateType.ONLY_DATE 默认值: DateType.TIME_PACK

.outputDir(System.getProperty("user.dir") + targetModuleNamePath + "/src/main/java"); // 指定输出目录

})

.packageConfig(builder -> {

builder.parent("org.ycloud.aipan") // 父包模块名

.entity("model") //Entity 包名 默认值:entity

.mapper("mapper") //Mapper 包名 默认值:mapper

.pathInfo(Collections.singletonMap(OutputFile.xml, System.getProperty("user.dir") + targetModuleNamePath + "/src/main/resources/mapper")); // 设置mapperXml生成路,默认存放在mapper的xml下

})

.dataSourceConfig(builder -> {//Mysql下tinyint字段转换

builder.typeConvertHandler((globalConfig, typeRegistry, metaInfo) -> {

if (JdbcType.TINYINT == metaInfo.getJdbcType()) {

return DbColumnType.BOOLEAN;

}

return typeRegistry.getColumnType(metaInfo);

});

})

.strategyConfig(builder -> {

builder.addInclude(tables) // 设置需要生成的表名 可变参数

.entityBuilder()// Entity策略配置

.enableFileOverride() // 开启生成Entity层文件覆盖

.idType(IdType.ASSIGN_ID)//主键策略 雪花算法自动生成的id

.enableLombok() //开启lombok

.logicDeleteColumnName("del")// 说明逻辑删除是哪个字段

.enableTableFieldAnnotation()// 属性加上注解说明

.formatFileName("%sDO") //格式化生成的文件名称

.controllerBuilder().disable()// Controller策略配置,这里不生成Controller层

.serviceBuilder().disable()// Service策略配置,这里不生成Service层

.mapperBuilder()// Mapper策略配置

.enableFileOverride() // 开启生成Mapper层文件覆盖

.formatMapperFileName("%sMapper")// 格式化Mapper文件名称

.superClass(BaseMapper.class) //继承的父类

.enableBaseResultMap() // 开启生成resultMap,

.enableBaseColumnList() // 开启生成Sql片段

.formatXmlFileName("%sMapper"); // 格式化xml文件名称

})

.templateConfig(builder -> {

// 不生成Controller

builder.disable(TemplateType.CONTROLLER,TemplateType.SERVICE,TemplateType.SERVICE_IMPL);

})

.execute(); // 执行生成

}

}

```

### 账号模块开发和Knife4j接口文档配置

#### Knife4j接口文档工具

* 什么是Knife4j

* 一个为Java MVC框架集成Swagger生成Api文档的增强解决方案,前身是swagger-bootstrap-ui。

* 提供了新的Web页面,更符合使用习惯和审美;补充了一些注解,扩展了原生Swagger的功能;

* 是一个更小巧、轻量且功能强悍的接口文档管理工具

* 核心功能

* **文档说明**:详细列出接口文档的说明,包括接口地址、类型、请求示例、请求参数、响应示例、响应参数、响应码等信息。

* **在线调试**:提供在线接口联调功能,自动解析当前接口参数,返回接口响应内容、headers、响应时间、响应状态码等信息。

* **接口搜索**:提供强大的接口搜索功能,支持按接口地址、请求方法、接口描述等关键字进行搜索。

* **接口过滤**:提供接口过滤功能,可以根据接口分组、接口标签、接口地址等条件进行过滤。

* **自定义主题**:支持自定义主题,定制个性化的API文档界面。

* **丰富的扩展功能**:如接口排序、接口分组、接口标签等,进一步丰富了API文档管理的功能。

* 配置实战

* 添加依赖

```xml

* 云盘存储相关设计说明

* 任何文件都有一个唯一标识,我们统一命名为 **identifier**,同个文件产生的标识是不变的

* 唯一标识(identifier)可以采用多个方案,也有对应的类库

* 哈希函数(如MD5、SHA-256)

* 优点:

* 唯一性:理论上 不同的文件内容会产生不同的哈希值,保证了标识的唯一性。

* 快速计算:哈希函数可以快速计算出文件的哈希值。

* 安全性:对于SHA-256等哈希算法,抗碰撞性较强,不易被篡改。

* 缺点:

* 安全性问题:对于MD5,由于其抗碰撞性较弱,已经不推荐用于安全敏感的应用。

* 存储和比较:哈希值需要存储和比较,对于非常大的文件系统,这可能会增加存储和计算开销。

* 基于内容的指纹(如SimHash、Locality-Sensitive Hashing)

* 优点:

* 相似性检测:适用于检测相似或重复的文件,可以容忍文件内容的微小变化。

* 减少存储:通过减少哈希值的位数来减少存储需求。

* 缺点:

* 计算复杂性:相比于简单的哈希函数,这些算法可能需要更复杂的计算。

* 误判率:在某些情况下可能会有误判,即不同的文件产生相同的指纹。

* 文件元数据组合

* 优点:

* 简单易实现:通过文件的大小、创建时间、修改时间等元数据生成标识。

* 快速检索:基于元数据的检索通常很快。

* 缺点:

* 非唯一性:不同的文件可能具有相同的元数据,特别是在文件被复制或修改的情况下。

* 不稳定性:文件的元数据(如修改时间)可能会改变,导致标识失效

* 方案:采用MD5, 相关标识可以前端和后端保持一定规则,前端上传的时候生成标识传递给后端

#### 账号表-文件表和关联关系表设计说明

* 三个关键表说明

* **account表**:存储用户的基本信息,如用户名、密码、头像等。这是用户身份验证和个性化设置的基础。

* **file表**:存储文件的元数据,包括文件名、大小、后缀、唯一标识符(MD5)等。主要用于跟踪文件的属性和文件的唯一性

* **account_file表**:

* 存储用户与文件之间的关系,包括文件的层级结构(文件夹和子文件),以及文件的类型和大小等信息。

* 这个表允许一个用户有多个子文件和文件夹,并且可以表示文件的层级关系

* 如果没有`account_file`表,

* 每个用户都重复上传,随着文件数量的增加,没有`account_file`表来组织文件结构,`file`表会变得非常大,性能问题

* 无法有效地表示文件和文件夹的层级结构

* 实现文件的移动、复制、删除等操作会变得复杂,因为没有一个明确的结构来跟踪文件的层级和用户关系

* 权限管理也会变得更加复杂,因为没有一个清晰的结构来定义哪些文件可以被哪些用户访问。

* 智能化云盘设计的3个表理解清楚

* 账号表

* 记录账号相关基础信息

* 关键字段

```

id 即后续用的 account_id

username

password

role 用户角色 COMMON, ADMIN

```

* 账号文件关系表

* 记录对应账号下的文件和文件夹、关系等

* 关键字段

```

id

account_id 账号ID

is_dir 是否是目录,0不是文件夹,1是文件夹

parent_id 上层文件夹ID,顶层文件夹为0

file_id 文件ID,真正存储的文件

file_name 文件名和实际存储的文件名区分开来,可能重命名

```

* 文件表

* 记录文件相关的物理存储信息

```

id 即file_id

account_id 哪个账号上传的

file_name 文件名

object_key 文件的key, 格式 日期/md5.拓展名,比如 2024/11/13/921674fd-cdaf-459a-be7b-109469e7050d.png

identifier 唯一标识,文件MD5

```

#### AI智能化云盘数据库设计和字段说明

* 数据库ER图设计(**后续还有调整相关表结构**)

* 导入建表语句

#### 智能化云盘数据库逆向工程配置生成

* 配置数据库

```java

public class MyBatisPlusGenerator {

public static void main(String[] args) {

String userName = "root";

String password = "xx";

String serverInfo = "127.0.0.1:3306";

String targetModuleNamePath = "/";

String dbName = "ycloud-aipan";

String[] tables = {

"account", "file","account_file","file_chunk", "file_suffix","file_type", "share", "share_file", "storage"

};

// 使用 FastAutoGenerator 快速配置代码生成器

FastAutoGenerator.create("jdbc:mysql://"+serverInfo+"/"+dbName+"?useUnicode=true&characterEncoding=utf-8&useSSL=false&serverTimezone=Asia/Shanghai&tinyInt1isBit=true", userName, password)

.globalConfig(builder -> {

builder.author("everyone") // 设置作者

.commentDate("yyyy-MM-dd")

.enableSpringdoc()

.disableOpenDir() //禁止打开输出目录

.dateType(DateType.ONLY_DATE) //定义生成的实体类中日期类型 DateType.ONLY_DATE 默认值: DateType.TIME_PACK

.outputDir(System.getProperty("user.dir") + targetModuleNamePath + "/src/main/java"); // 指定输出目录

})

.packageConfig(builder -> {

builder.parent("org.ycloud.aipan") // 父包模块名

.entity("model") //Entity 包名 默认值:entity

.mapper("mapper") //Mapper 包名 默认值:mapper

.pathInfo(Collections.singletonMap(OutputFile.xml, System.getProperty("user.dir") + targetModuleNamePath + "/src/main/resources/mapper")); // 设置mapperXml生成路,默认存放在mapper的xml下

})

.dataSourceConfig(builder -> {//Mysql下tinyint字段转换

builder.typeConvertHandler((globalConfig, typeRegistry, metaInfo) -> {

if (JdbcType.TINYINT == metaInfo.getJdbcType()) {

return DbColumnType.BOOLEAN;

}

return typeRegistry.getColumnType(metaInfo);

});

})

.strategyConfig(builder -> {

builder.addInclude(tables) // 设置需要生成的表名 可变参数

.entityBuilder()// Entity策略配置

.enableFileOverride() // 开启生成Entity层文件覆盖

.idType(IdType.ASSIGN_ID)//主键策略 雪花算法自动生成的id

.enableLombok() //开启lombok

.logicDeleteColumnName("del")// 说明逻辑删除是哪个字段

.enableTableFieldAnnotation()// 属性加上注解说明

.formatFileName("%sDO") //格式化生成的文件名称

.controllerBuilder().disable()// Controller策略配置,这里不生成Controller层

.serviceBuilder().disable()// Service策略配置,这里不生成Service层

.mapperBuilder()// Mapper策略配置

.enableFileOverride() // 开启生成Mapper层文件覆盖

.formatMapperFileName("%sMapper")// 格式化Mapper文件名称

.superClass(BaseMapper.class) //继承的父类

.enableBaseResultMap() // 开启生成resultMap,

.enableBaseColumnList() // 开启生成Sql片段

.formatXmlFileName("%sMapper"); // 格式化xml文件名称

})

.templateConfig(builder -> {

// 不生成Controller

builder.disable(TemplateType.CONTROLLER,TemplateType.SERVICE,TemplateType.SERVICE_IMPL);

})

.execute(); // 执行生成

}

}

```

### 账号模块开发和Knife4j接口文档配置

#### Knife4j接口文档工具

* 什么是Knife4j

* 一个为Java MVC框架集成Swagger生成Api文档的增强解决方案,前身是swagger-bootstrap-ui。

* 提供了新的Web页面,更符合使用习惯和审美;补充了一些注解,扩展了原生Swagger的功能;

* 是一个更小巧、轻量且功能强悍的接口文档管理工具

* 核心功能

* **文档说明**:详细列出接口文档的说明,包括接口地址、类型、请求示例、请求参数、响应示例、响应参数、响应码等信息。

* **在线调试**:提供在线接口联调功能,自动解析当前接口参数,返回接口响应内容、headers、响应时间、响应状态码等信息。

* **接口搜索**:提供强大的接口搜索功能,支持按接口地址、请求方法、接口描述等关键字进行搜索。

* **接口过滤**:提供接口过滤功能,可以根据接口分组、接口标签、接口地址等条件进行过滤。

* **自定义主题**:支持自定义主题,定制个性化的API文档界面。

* **丰富的扩展功能**:如接口排序、接口分组、接口标签等,进一步丰富了API文档管理的功能。

* 配置实战

* 添加依赖

```xml

* knife4j 访问地址:http://localhost:8080/doc.html

* Swagger2.0访问地址:http://localhost:8080/swagger-ui.html

* Swagger3.0访问地址:http://localhost:8080/swagger-ui/index.html

*/

@Slf4j

@Configuration

public class Knife4jConfig {

@Bean

public OpenAPI customOpenAPI() {

return new OpenAPI()

.info(new Info()

.title("AI智能云盘系统 API")

.version("1.0-SNAPSHOT")

.description("AI智能云盘系统")

.termsOfService("https://www.xxx.net")

.license(new License().name("Apache 2.0").url("https://www.xxx.net"))

// 添加作者信息

.contact(new Contact()

.name("anonymity") // 替换为作者的名字

.email("anonymity@qq.com") // 替换为作者的电子邮件

.url("https://www.xxx.net") // 替换为作者的网站或个人资料链接

)

);

}

}

```

* 配置Spring Boot控制台打印

```java

@Slf4j

@SpringBootApplication

public class CloudApplication {

public static void main(String[] args) throws Exception {

ConfigurableApplicationContext application = SpringApplication.run(CloudApplication.class, args);

Environment env = application.getEnvironment();

log.info("\n----------------------------------------------------------\n\t" +

"Application '{}' is running! Access URLs:\n\t" +

"Local: \t\thttp://localhost:{}\n\t" +

"External: \thttp://{}:{}\n\t" +

"API文档: \thttp://{}:{}/doc.html\n" +

"----------------------------------------------------------",

env.getProperty("spring.application.name"),

env.getProperty("server.port"),

InetAddress.getLocalHost().getHostAddress(),

env.getProperty("server.port"),

InetAddress.getLocalHost().getHostAddress(),

env.getProperty("server.port"));

}

}

```

#### 账号注册相关模块接口开发实战

* 需求

* 开发用户注册相关接口,手机号注册

* 内部使用, 不加验证码,如果需要对外则可以加入验证码逻辑

* 用户板块不做复杂权限或者多重校验处理等

* 逻辑说明

* 根据手机号查询是否重复(或者唯一索引)

* 密码加密处理

* 保存用户注册逻辑

* 其他逻辑(创建默认的存储空间,初始化根目录)

* 编码实战:

> 编写`AccountController,AccountRegisterReq,AccountService,AccountConfig`...

```sql

CREATE TABLE `account` (

`id` bigint NOT NULL COMMENT 'ID',

`username` varchar(255) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci NOT NULL COMMENT '用户名',

`password` varchar(255) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci NOT NULL COMMENT '密码',

`avatar_url` varchar(255) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci DEFAULT NULL COMMENT '用户头像',

`phone` varchar(255) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci DEFAULT NULL COMMENT '手机号',

`role` varchar(255) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci DEFAULT 'COMMON' COMMENT '用户角色 COMMON, ADMIN',

`del` tinyint DEFAULT '0' COMMENT '逻辑删除(1删除 0未删除)',

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP ON UPDATE CURRENT_TIMESTAMP COMMENT '更新时间',

PRIMARY KEY (`id`) USING BTREE,

UNIQUE KEY `idx_phone_uni` (`phone`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8mb4 COLLATE=utf8mb4_general_ci ROW_FORMAT=DYNAMIC COMMENT='用户信息表';

```

#### 头像上传接口开发和MinIO权限配置

* 需求

* 开发头像上传接口,用户注册时候需要把头像url进行上传

* **存储到minio需要可以公开访问,和文件存储分开bucket**

* 逻辑说明

* 文件上传接口

* 返回文件访问路径

* **配置minio的头像存储bucket存储权限为public**

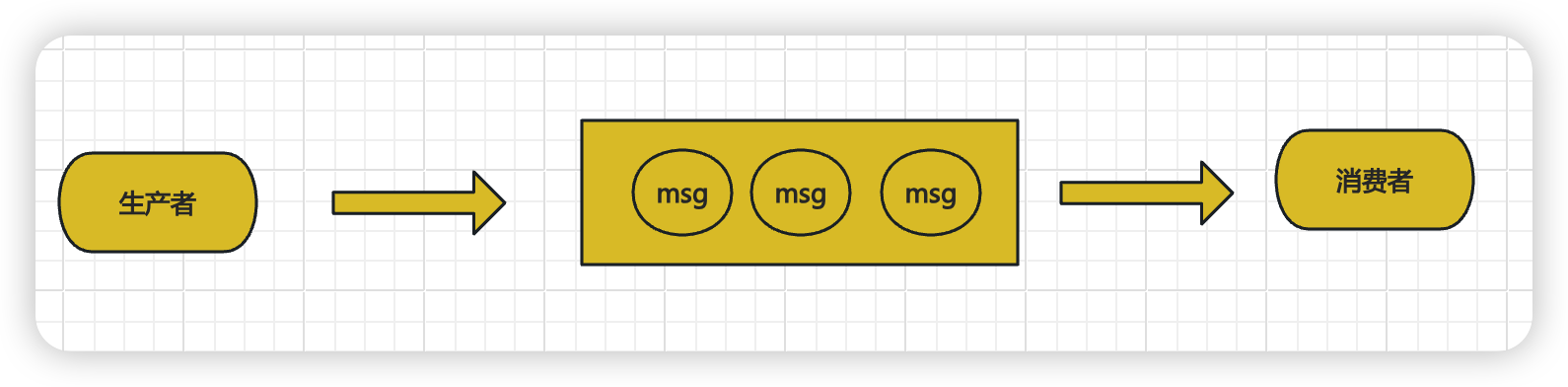

#### 网盘存储容量设计和根目录初始化配置

* 需求

* **问题一:新用户注册,有默认网盘存储容量,什么时候进行初始化?**

* 答案

* 用户注册的时候一并配置相关的初始化内容

* 如果是简单场景:直接调用; 复杂场景:结合消息队列

* 类似场景大家可以思考下还有哪些,各大公司拉新活动折扣

* 1、检查父文件ID是否存在,避免越权

* 2、检查文件名是否重复

* 3、保存文件信息

*

* @return

*/

private Long saveAccountFile(AccountFileDTO accountFileDTO) {

//检查父文件ID是否存在

checkParentFileId(accountFileDTO);

//存储文件信息

AccountFileDO accountFileDO = SpringBeanUtil.copyProperties(accountFileDTO, AccountFileDO.class);

//检查文件名是否重复

processFileNameDuplicate(accountFileDO);

accountFileMapper.insert(accountFileDO);

return accountFileDO.getId();

}

```

#### 网盘文件重命名相关接口

* 需求

* 开发网盘文件重命名接口,包括文件夹和文件一样适用

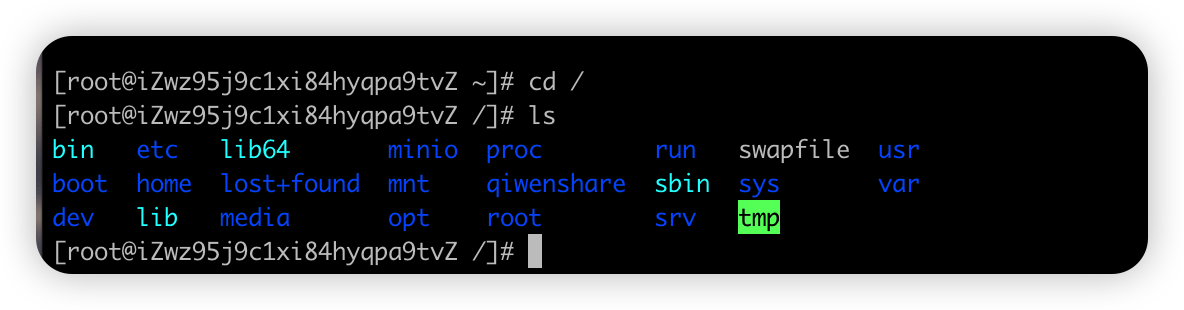

* **问题二:网盘文件存储有个根目录,这个如何进行设计?**

* 上传文件的到根目录,这个相关的parent_id是怎么填写?

* 答案:参考Linux操作系统,根目录也是一个目录

* 开发编码实战:创建文件夹

```java

//3.创建默认的存储空间

StorageDO storageDO = new StorageDO();

storageDO.setAccountId(accountDO.getId());

storageDO.setUsedSize(0L);

storageDO.setTotalSize(AccountConfig.DEFAULT_STORAGE_SIZE);

storageMapper.insert(storageDO);

//4.初始化根目录

FolderCreateReq createRootFolderReq = FolderCreateReq.builder()

.accountId(accountDO.getId())

.parentId(AccountConfig.ROOT_PARENT_ID)

.folderName(AccountConfig.ROOT_FOLDER_NAME)

.build();

accountFileService.createFolder(createRootFolderReq);

```

#### 账号登录相关模块设计和开发实战

* 需求

* 开发用户登录模块

* 配置生成JWT

* 编码实战

```java

//业务逻辑

public AccountDTO login(AccountLoginReq req) {

String encryptPassword = DigestUtils.md5DigestAsHex(( AccountConfig.ACCOUNT_SALT+ req.getPassword()).getBytes());

QueryWrapper

* **问题二:网盘文件存储有个根目录,这个如何进行设计?**

* 上传文件的到根目录,这个相关的parent_id是怎么填写?

* 答案:参考Linux操作系统,根目录也是一个目录

* 开发编码实战:创建文件夹

```java

//3.创建默认的存储空间

StorageDO storageDO = new StorageDO();

storageDO.setAccountId(accountDO.getId());

storageDO.setUsedSize(0L);

storageDO.setTotalSize(AccountConfig.DEFAULT_STORAGE_SIZE);

storageMapper.insert(storageDO);

//4.初始化根目录

FolderCreateReq createRootFolderReq = FolderCreateReq.builder()

.accountId(accountDO.getId())

.parentId(AccountConfig.ROOT_PARENT_ID)

.folderName(AccountConfig.ROOT_FOLDER_NAME)

.build();

accountFileService.createFolder(createRootFolderReq);

```

#### 账号登录相关模块设计和开发实战

* 需求

* 开发用户登录模块

* 配置生成JWT

* 编码实战

```java

//业务逻辑

public AccountDTO login(AccountLoginReq req) {

String encryptPassword = DigestUtils.md5DigestAsHex(( AccountConfig.ACCOUNT_SALT+ req.getPassword()).getBytes());

QueryWrapper * 逻辑说明

* 步骤一

* 进入首页需要先获取用户的根目录文件夹ID

* 通过根目录文件夹ID去获取对应的文件列表

* 步骤二

* 首页需要显示用户的存储空间

* 编码实战

```java

public AccountDTO queryDetail(Long accountId) {

//账号详情

AccountDO accountDO = accountMapper.selectById(accountId);

AccountDTO accountDTO = SpringBeanUtil.copyProperties(accountDO, AccountDTO.class);

//存储信息

StorageDO storageDO = storageMapper.selectOne(new QueryWrapper

* 逻辑说明

* 步骤一

* 进入首页需要先获取用户的根目录文件夹ID

* 通过根目录文件夹ID去获取对应的文件列表

* 步骤二

* 首页需要显示用户的存储空间

* 编码实战

```java

public AccountDTO queryDetail(Long accountId) {

//账号详情

AccountDO accountDO = accountMapper.selectById(accountId);

AccountDTO accountDTO = SpringBeanUtil.copyProperties(accountDO, AccountDTO.class);

//存储信息

StorageDO storageDO = storageMapper.selectOne(new QueryWrapper AI补充接口文档和注释字段操作

* AI补充API接口文档

* `补充knife4j的接口文档配置内容,@Tag @Operation等注解,使用v3`

* AI补充字段解释说明

* `补充knife4j接口文档信息,使用@Schema,使用v3,添加参数举例`

### 网盘文件模块基础设计和开发

#### 资源访问安全之web常见越权攻击和防范

* **越权攻击介绍**

* 是Web应用程序中一种常见的漏洞,由于其存在范围广、危害 大, 列为Web应用十大安全隐患的第二名

* 指应用在检查授权时存在纰漏,使得攻击者在获得低权限用户账户后,利用一些方式绕过权限检查,访问或者操作其他用户

* 产生原因:主要是因为开发人员在对数据进行增、删、改、查询时对客户端请求的数据过分相信,而遗漏了权限的判定

* 比如网盘里面:分享、转存、查看文件的时候都容易触发

* **水平越权攻击**

- 指的是攻击者通过某种手段获取了与自己权限相同的其他账户的访问权限。

- 用户A能够访问用户B的账户信息,尽管他们都是普通用户,但A不应该能够访问B的数据。

- 技术实现方式

- **参数篡改**:

- 攻击者通过修改请求中的用户ID参数,尝试访问其他同级别用户的资源。

- 在电商系统中,用户A通过修改订单ID参数,尝试查看或修改用户B的订单信息。

- **会话劫持**:

- 攻击者通过某种方式获取了其他用户的会话信息,从而冒充该用户进行操作,这可能导致水平越权问题。

- **利用前端安全漏洞**:

- 如果前端安全措施不当,攻击者可能会通过修改前端显示的界面元素,如隐藏的URL或参数,来访问其他用户的数据。

* **水平越权攻击的防范**:

- **权限验证**:确保每次数据访问都进行严格的权限验证。

- **数据隔离**:不同用户的数据应该在数据库层面进行隔离。

- **会话管理**:使用安全的会话管理机制,如HTTPS、Token等。

* **垂直越权攻击**

- 指的是攻击者通过某种手段获取了更高权限的账户的访问权限。

- 普通用户获取了管理员账户或者更高的权限。

- 技术实现方式

- **权限配置错误**:

- 由于系统配置不当,普通用户能够执行管理员级别的操作,例如通过修改请求中的权限参数来提升权限。

- **利用系统漏洞**:

- 攻击者利用系统或应用程序的漏洞提升权限,例如通过SQL注入攻击来执行管理员级别的数据库操作。

- **多阶段功能滥用**:

- 在多阶段功能实现中,如果后续阶段不再验证用户身份,攻击者可能通过抓包修改参数值,实现越权操作,如修改任意用户密码

- **垂直越权攻击的防范**:

- **最小权限原则**:用户和系统组件应该只拥有完成其任务所必需的最小权限。

- **权限审查**:定期审查权限设置,确保没有不必要的权限提升。

- **安全编码**:遵循安全编码实践,避免常见的安全漏洞,如SQL注入、跨站脚本(XSS)等。

- **安全审计**:实施安全审计,监控和记录关键操作,以便在发生安全事件时进行追踪。

* 智能化网盘项目里面的避免越权处理方案

* 相关文件数据处理,加入account_id确认

* 角色权限通过role进行确认操作

#### 文件模块开发之查询文件列表接口开发

* 需求

* 网盘存储首页进入,会触发哪些请求?**获取当前用户根目录文件夹**

* 根据根目录文件夹查询对应的文件列表

* 进入相关的指定文件夹,查询对应的子文件

AI补充接口文档和注释字段操作

* AI补充API接口文档

* `补充knife4j的接口文档配置内容,@Tag @Operation等注解,使用v3`

* AI补充字段解释说明

* `补充knife4j接口文档信息,使用@Schema,使用v3,添加参数举例`

### 网盘文件模块基础设计和开发

#### 资源访问安全之web常见越权攻击和防范

* **越权攻击介绍**

* 是Web应用程序中一种常见的漏洞,由于其存在范围广、危害 大, 列为Web应用十大安全隐患的第二名

* 指应用在检查授权时存在纰漏,使得攻击者在获得低权限用户账户后,利用一些方式绕过权限检查,访问或者操作其他用户

* 产生原因:主要是因为开发人员在对数据进行增、删、改、查询时对客户端请求的数据过分相信,而遗漏了权限的判定

* 比如网盘里面:分享、转存、查看文件的时候都容易触发

* **水平越权攻击**

- 指的是攻击者通过某种手段获取了与自己权限相同的其他账户的访问权限。

- 用户A能够访问用户B的账户信息,尽管他们都是普通用户,但A不应该能够访问B的数据。

- 技术实现方式

- **参数篡改**:

- 攻击者通过修改请求中的用户ID参数,尝试访问其他同级别用户的资源。

- 在电商系统中,用户A通过修改订单ID参数,尝试查看或修改用户B的订单信息。

- **会话劫持**:

- 攻击者通过某种方式获取了其他用户的会话信息,从而冒充该用户进行操作,这可能导致水平越权问题。

- **利用前端安全漏洞**:

- 如果前端安全措施不当,攻击者可能会通过修改前端显示的界面元素,如隐藏的URL或参数,来访问其他用户的数据。

* **水平越权攻击的防范**:

- **权限验证**:确保每次数据访问都进行严格的权限验证。

- **数据隔离**:不同用户的数据应该在数据库层面进行隔离。

- **会话管理**:使用安全的会话管理机制,如HTTPS、Token等。

* **垂直越权攻击**

- 指的是攻击者通过某种手段获取了更高权限的账户的访问权限。

- 普通用户获取了管理员账户或者更高的权限。

- 技术实现方式

- **权限配置错误**:

- 由于系统配置不当,普通用户能够执行管理员级别的操作,例如通过修改请求中的权限参数来提升权限。

- **利用系统漏洞**:

- 攻击者利用系统或应用程序的漏洞提升权限,例如通过SQL注入攻击来执行管理员级别的数据库操作。

- **多阶段功能滥用**:

- 在多阶段功能实现中,如果后续阶段不再验证用户身份,攻击者可能通过抓包修改参数值,实现越权操作,如修改任意用户密码

- **垂直越权攻击的防范**:

- **最小权限原则**:用户和系统组件应该只拥有完成其任务所必需的最小权限。

- **权限审查**:定期审查权限设置,确保没有不必要的权限提升。

- **安全编码**:遵循安全编码实践,避免常见的安全漏洞,如SQL注入、跨站脚本(XSS)等。

- **安全审计**:实施安全审计,监控和记录关键操作,以便在发生安全事件时进行追踪。

* 智能化网盘项目里面的避免越权处理方案

* 相关文件数据处理,加入account_id确认

* 角色权限通过role进行确认操作

#### 文件模块开发之查询文件列表接口开发

* 需求

* 网盘存储首页进入,会触发哪些请求?**获取当前用户根目录文件夹**

* 根据根目录文件夹查询对应的文件列表

* 进入相关的指定文件夹,查询对应的子文件

* 注意事项

* 查询的时候都需要加入账号相关进行确认

**前面代码相对会简单点,逐步代码封装和抽取就会上升难度,**

* 编码实战

```java

@GetMapping("list")

public JsonData list(@RequestParam(value = "parent_id")Long parentId){

Long accountId = LoginInterceptor.threadLocal.get().getId();

List

* 注意事项

* 查询的时候都需要加入账号相关进行确认

**前面代码相对会简单点,逐步代码封装和抽取就会上升难度,**

* 编码实战

```java

@GetMapping("list")

public JsonData list(@RequestParam(value = "parent_id")Long parentId){

Long accountId = LoginInterceptor.threadLocal.get().getId();

List * 业务逻辑方法梳理

* 文件ID是否存在,避免越权

* 新旧文件名称不能一样

* 也不能用同层文件夹的名称,通过parent_id进行查询

* 编码实战

```java

@Override

public void renameFile(FileUpdateReq req) {

//文件ID是否存在,避免越权

AccountFileDO accountFileDO = accountFileMapper.selectOne(new QueryWrapper

* 业务逻辑方法梳理

* 文件ID是否存在,避免越权

* 新旧文件名称不能一样

* 也不能用同层文件夹的名称,通过parent_id进行查询

* 编码实战

```java

@Override

public void renameFile(FileUpdateReq req) {

//文件ID是否存在,避免越权

AccountFileDO accountFileDO = accountFileMapper.selectOne(new QueryWrapper * 业务逻辑设计(哪些方法会复用)

* 检查被转移的文件ID是否合法(复用)

* 检查目标文件夹ID是否合法(复用)

* 目标文件夹ID必须是当前用户的文件夹,不能是文件

* 要操作(移动、复制)的文件列表不能包含是目标文件夹的子文件夹,递归处理

* 批量转移文件到目标文件夹

* 处理重复文件名

* 更新文件或文件夹的parentId为目标文件夹ID

* 编码实战

* 业务逻辑设计(哪些方法会复用)

* 检查被转移的文件ID是否合法(复用)

* 检查目标文件夹ID是否合法(复用)

* 目标文件夹ID必须是当前用户的文件夹,不能是文件

* 要操作(移动、复制)的文件列表不能包含是目标文件夹的子文件夹,递归处理

* 批量转移文件到目标文件夹

* 处理重复文件名

* 更新文件或文件夹的parentId为目标文件夹ID

* 编码实战

```java

@Transactional(rollbackFor = Exception.class)

public void moveBatch(FileBatchReq req) {

//检查被转移的文件ID是否合法

List

```java

@Transactional(rollbackFor = Exception.class)

public void moveBatch(FileBatchReq req) {

//检查被转移的文件ID是否合法

List * 编码实现

* 编码实现

* 检查父ID是否合法

```java

private void checkTargetParentIdLegal(FileBatchReq req) {

//1、目标文件夹ID 必须是当前用户的文件夹,不能是文件

AccountFileDO targetParentFolder = accountFileMapper.selectOne(new QueryWrapper

* 检查父ID是否合法

```java

private void checkTargetParentIdLegal(FileBatchReq req) {

//1、目标文件夹ID 必须是当前用户的文件夹,不能是文件

AccountFileDO targetParentFolder = accountFileMapper.selectOne(new QueryWrapper * `findAllAccountFileDOWithRecur` 递归逻辑处理(多个地方会使用,封装方法)

```java

@Override

public void findAllAccountFileDOWithRecur(List

* `findAllAccountFileDOWithRecur` 递归逻辑处理(多个地方会使用,封装方法)

```java

@Override

public void findAllAccountFileDOWithRecur(List * LangServer

* 部署工具,可将LangChain应用快速转换为REST API,支持并行处理、流式传输和异步调用

* 自动生成OpenAPI文档, 滚动更新支持, 内置Prometheus指标, 适用于企业级生产环境

* LangServer

* 部署工具,可将LangChain应用快速转换为REST API,支持并行处理、流式传输和异步调用

* 自动生成OpenAPI文档, 滚动更新支持, 内置Prometheus指标, 适用于企业级生产环境

* LangSmith

* 开发者调试与监控平台,支持对LLM应用的性能分析、测试和部署优化

* 提供可视化调试界面和自动化评估工具,提升开发效率与可靠性

* LangGraph

* 状态管理工具,用于构建多代理系统,支持流式处理和复杂任务分解

* 可视化流程设计器, 循环/条件分支支持,分布式状态持久化, 自动断点续跑

* 产品矩阵对比

| **产品** | **核心价值** | **Java生态对标** | **适用场景** |

| :------------: | :----------------: | :------------------: | :----------------------: |

| LangSmith | 全生命周期可观测性 | Prometheus + Grafana | 生产环境监控、效果评估 |

| LangServe | 快速服务化 | Spring Boot | 模型API部署、快速原型 |

| LangGraph | 复杂流程编排 | Activiti BPMN | 业务工作流设计、状态管理 |

| LangChain Core | 基础组件库 | Spring AI | 基础AI功能开发 |

#### Python虚拟环境evn应用讲解和实战

* 什么是Python的虚拟环境

* 类似虚拟机、沙箱机制一样,隔离不同的项目依赖的环境

* 核心作用

* **隔离项目依赖**:不同项目可能依赖同一库的不同版本。

* **避免全局污染**:防止安装过多全局包导致冲突。

* **便于协作**:通过依赖清单(如`requirements.txt`)复现环境

* 虚拟环境 vs 全局环境

| **特性** | **虚拟环境** | **全局环境** |

| :----------: | :--------------------------: | :------------------------: |

| **依赖隔离** | 项目独立,互不影响 | 所有项目共享 |

| **安全性** | 避免权限问题(无需sudo安装) | 需谨慎操作(可能影响系统) |

| **适用场景** | 开发、测试、多版本项目 | 系统级工具或少量通用库 |

* 镜像源配置

* 查看系统配置的镜像源操作

```shell

pip config list

pip config get global.index-url

```

* 配置国内镜像源

```shell

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

```

* 虚拟环境基础操作

* 创建虚拟环境

```shell

# 语法:python -m venv <环境目录名>

python -m venv myenv # 创建名为myenv的虚拟环境

```

* 激活虚拟环境

* Windows(CMD/PowerShell)

```shell

myenv\Scripts\activate.bat # CMD

myenv\Scripts\Activate.ps1 # PowerShell(需管理员权限解除限制)

```

* Linux/macOS:

```shell

source myenv/bin/activate

```

* 激活后提示符变化

```shell

source myenv/bin/activate

```

* 退出虚拟环境

```shell

deactivate

```

* 依赖管理

* 安装库到虚拟环境

```shell

# 激活环境后操作

(myenv) pip install requests # 安装最新版本

(myenv) pip install django==3.2 # 安装指定版本

```

* 导出依赖清单

```shell

(myenv) pip freeze > requirements.txt

```

* 从清单恢复依赖

```shell

# 在新环境中执行

(myenv) pip install -r requirements.txt

```

* 最佳实践与案例

* 典型项目流程(区分Linux、Mac和Window)

```shell

# 创建项目目录并进入

mkdir myproject && cd myproject

# 创建虚拟环境

python -m venv .venv

# 激活环境(Windows: .venv\Scripts\activate)

source .venv/bin/activate

# 安装依赖

pip install django pandas

# 导出依赖

pip freeze > requirements.txt

# 开发完成后退出

deactivate

```

* 协作复现环境

```shell

# 克隆项目后操作

git clone https://github.com/user/project.git

cd project

# 创建并激活虚拟环境

python -m venv .venv

source .venv/bin/activate

# 安装依赖

pip install -r requirements.txt

```

* 常见问题与解决

* 虚拟环境激活失败

* 现象:source: command not found

* 原因:在Windows使用Linux命令或在Linux未使用source。

* 解决:根据操作系统选择正确激活命令。

* 跨平台路径问题

* 问题:Windows与Linux路径格式差异导致脚本无法运行。

* 方案:使用/统一路径分隔符,或在代码中处理路径

* 依赖版本冲突

* 场景:项目A需要`numpy==1.18`,项目B需要`numpy==1.20`。

* 解决:为每个项目创建独立虚拟环境。

* 案例实战:

* LangChain框架环境搭建

#### VSCode编辑器LangChain环境安装和验证

* Python虚拟环境和项目创建

* 创建虚拟环境(Windows/macOS/Linux通用)

```python

# 创建环境目录

python -m venv langchain_env

```

* 激活虚拟环境

* **Windows**

```python

.\langchain_env\Scripts\activate

```

* **macOS/Linux**

```python

source langchain_env/bin/activate

```

* 验证环境

```python

# 查看Python路径(应显示虚拟环境路径)

which python # macOS/Linux

where python # Windows

```

* LangChain环境安装

* 安装核心依赖包 (**版本和课程保持一致,不然很多不兼容!!!**)

* 下载相关资料 ,使用**【wget】或者【浏览器】远程下载相关依赖包(需要替换群里最新的)**

```python

原生资料下载方式(账号 - 密码 - ip地址 - 端口 需要替换群里最新的,【其他路径不变】)

wget --http-user=用户名 --http-password=密码 http://ip:端口/dcloud_pan/aipan_install_1.zip

#比如 命令行下

wget --http-user=admin --http-password=xdclass.net888 http://47.115.31.28:9088/dcloud_pan/aipan_install_1.zip

# 比如 浏览器直接访问

http://47.115.31.28:9088/dcloud_pan/aipan_install_1.zip

```

* 解压后执行【**依赖很多,版本差异大,务必按照下面执行,否则课程无法进行下去,加我微信 xdclass6**】

```python

# 安装依赖

pip install -r requirements.txt

```

* 验证安装【很多模块后续使用会验证】

```python

# 执行简单测试

from langchain_core.prompts import ChatPromptTemplate

print(ChatPromptTemplate.from_template("Hello 欢迎来到小滴课堂-AI大模型开发课程 {title}!").format(title=",干就完了"))

# 应输出: Human: Hello 欢迎来到小滴课堂-AI大模型开发课程 ,干就完了!

```

#### LangChain框架模块和大模型IO交互链路讲解

**简介: LangChain框架模块和大模型IO交互链路讲解**

* 大模型IO交互链路概览

* LangChain模块对比大家熟知的Java Spring生态

| LangChain模块 | Spring对应技术 | 交互方式差异 |

| :-----------: | :-------------: | :----------------: |

| Models | Spring AI | 多模型热切换支持 |

| Memory | Redis/Hazelcast | 内置对话上下文管理 |

| Chains | Activity工作流 | 动态流程重组能力 |

| Agents | Drools规则引擎 | 基于LLM的决策机制 |

* LangChain架构六大模块(后续围绕模块逐步深入)

* **Models(模型层)**

- 相当于`interface LLM`,支持多种大模型(OpenAI/Gemini等)

- 示例:就像Java中的JDBC接口,可以对接不同数据库

* **Prompts(提示工程)**

- 相当于模板引擎(类似Thymeleaf)

```python

from langchain.prompts import PromptTemplate

template = """

你是一个Java专家,请用比喻解释{concept}:

要求:

1. 用{framework}框架做类比

2. 不超过2句话

"""

prompt = PromptTemplate.from_template(template)

print(prompt.format(concept="机器学习", framework="Spring"))

```

* **Chains(任务链)**

- 类似Java的工作流引擎,将多个组件组合在一起,创建一个单一、连贯的任务

- 包括不同的链之间组合

```python

from langchain.chains import LLMChain

# 创建任务链(类似Java的链式调用)

chain = LLMChain(llm=model, prompt=prompt)

result = chain.run(concept="多线程", framework="Spring Batch")

```

* **Memory(记忆)**

- 类似HTTP Session的会话管理

```python

from langchain.memory import ConversationBufferMemory

memory = ConversationBufferMemory()

memory.save_context({"input": "你好"}, {"output": "您好!"})

```

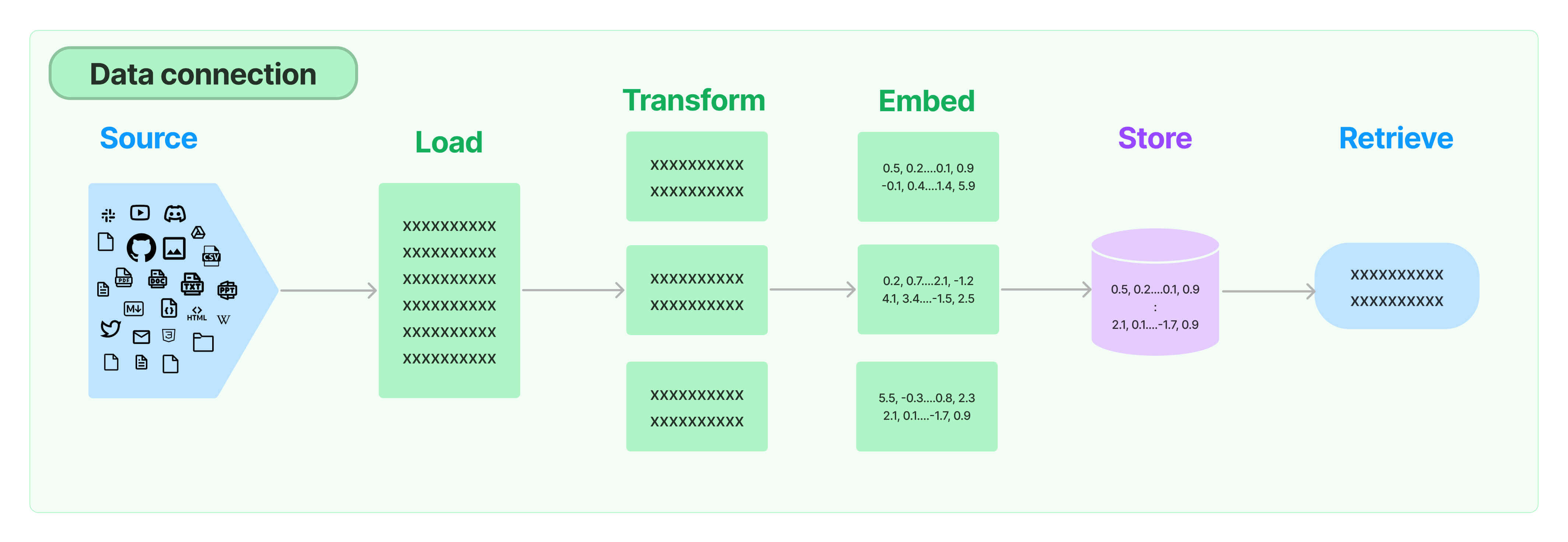

* **Indexes(索引)**

- 类似数据库索引+JDBC连接

- 对不通的文档进行结构化的方法,包括提取、切割、向量存储等,方便 LLM 能够更好的与之交互

```python

from langchain.document_loaders import WebBaseLoader

# 加载外部数据(类似JDBC读取数据库)

loader = WebBaseLoader("https://docs.spring.io/spring-boot/docs/current/reference/html/")

docs = loader.load()

```

* **Agents(智能体)**

- 类似策略模式+工厂模式,比chain更高级,可以自己选择调用链路

- 比如下一步有多个选择, 包括不同工具、流程链路等,由程序自己选择

```python

from langchain.agents import Tool, initialize_agent

tools = [

Tool(name="Calculator",

func=lambda x: eval(x),

description="计算数学表达式")

]

agent = initialize_agent(tools, llm, agent="zero-shot-react-description")

```

* 常见分层设计和交互如下

```python

+----------------+

| 应用层 (Agents) |

+----------------+

| 编排层 (Chains) |

+----------------+

| 能力层 (Tools) |

+----------------+

| 模型层 (Models) |

+----------------+

| 数据层 (Memory) |

+----------------+

```

#### 大模型Model-IO链路抽象和Chat模型开发

**简介: 大模型Model-IO链路抽象和Chat模型实战**

* 大模型使用开发的Model IO链路核心三要素

| 组件 | 作用 | 典型类/方法 |

| :---------: | :------------------------: | :-------------------------------------------: |

| **Prompts** | 构建模型输入的结构化模板 | `ChatPromptTemplate`, `FewShotPromptTemplate` |

| **Models** | 对接不同LLM服务的统一接口 | `ChatOpenAI` |

| **Parsers** | 将模型输出转换为结构化数据 | `StrOutputParser`, `JsonOutputParser` |

* LangChain支持的模型类型说明

* 文本生成模型(Text Generation Models-逐渐少用了,Chat更强大)

* 功能:生成连贯文本,主要用于处理文本相关的任务,如自然语言理解、文本生成、情感分析、翻译

* 典型模型:GPT-3、Claude、PaLM

* 对话模型(Chat Models,多数采用这个)

* 功能:处理多轮对话,人机交互中的对话能力,能够进行自然流畅的对话交流,适用于客户服务、智能助手

* 典型模型:GPT-4、Claude-2

* 嵌入模型(Embedding Models)

* 功能:生成文本向量表示,将文本转换为固定长度的向量表示,向量保留了数据的语义信息,便于后续的相似度计算、分类等任务。

* 典型模型:text-embedding-ada-002

* 多模态模型(Multimodal Models)

* 功能:处理文本+图像,例如文本、图像、音频等,更全面的信息理解和处理能力。

* 典型模型:GPT-4V、Qwen-omni-turbo

* 其他更多....

* LangChain开发LLM聊天模型快速编码实战

```python

from langchain_openai import ChatOpenAI

# 调用Chat Completion API

llm = ChatOpenAI(

model_name='qwen-plus',

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",

api_key="sk-0903038424424850a88ed161845d7d4c")

response = llm.invoke('你是谁?')

print(response)

```

#### 类型增强模块Typing应用和案例》

* Python的动态类型痛点

```python

# 传统动态类型代码示例

def calculate(a, b):

return a + b # 无法直观看出参数类型和返回值类型

result1 = calculate(3, 5) # ✅ 正确用法

result2 = calculate("3", 5) # ❌ 运行时才报错

```

* 什么是Typing模块

* 自python3.5开始,PEP484为python引入了类型注解(type hints), 为Python带来了类型提示和类型检查的能力。

* 允许开发者在代码中添加类型注解,提高代码的可读性和可维护性。

* 尽管Python是一种动态类型语言,但类型注解能让开发者更清晰地了解函数和变量的预期类型

* 核心

* **提升代码可读性**:明确参数和返回类型

* **增强IDE支持**:智能提示与自动补全

* **静态类型检查**:开发阶段发现潜在错误

* **完善文档生成**:自动生成类型化API文档

* 核心语法快速入门

* 简单类型(Primitive Types)

* Python内置的基本数据类型注解

* 适用场景:变量、函数参数、返回值的简单类型声明

* 类型注解不影响运行时行为

* 兼容子类型(如int注解可接受bool值)

```

age: int = 25 # 整数类型

name: str = "Alice" # 字符串类型

price: float = 9.99 # 浮点数类型

is_valid: bool = True # 布尔类型

data: bytes = b"binary" # 字节类型

```

* 容器类型

* 有多种内置的类型别名,比如`List`、`Tuple`、`Dict`等,可用于注解变量和函数的预期类型

* 例如

* `Dict[str, int]`表示键是字符串类型,值是整数类型的字典

* `Set[int]`表示整数类型的集合

* `List`同质元素的序列容器

* 适用场景:列表类型数据,元素类型相同

```python

from typing import List

scores: List[int] = [90, 85, 95] # 整型列表

matrix: List[List[float]] = [[1.1, 2.2], [3.3]] # 嵌套列表

```

* `Dict` 键值对映射容器

* 适用场景:字典类型数据,需指定键值类型

```python

from typing import Dict

person: Dict[str, str] = {"name": "Bob", "job": "dev"} # 字符串字典

config: Dict[str, Union[int, str]] = {"timeout": 30} # 混合值类型

```

* `Tuple`固定长度、类型的不可变序列

- 适用场景:坐标、数据库记录等固定结构

- 变长声明:`Tuple[T, ...]`:元素类型相同但长度不限 , ():空元组

```python

from typing import Tuple

point: Tuple[float, float] = (3.14, 2.71) # 二元坐标

rgb: Tuple[int, int, int] = (255, 0, 128) # 颜色值

flexible: Tuple[str, ...] = ("a", "b", "c") # 任意长度元组

```

* `Set` 无序不重复元素的集合

- 适用场景:去重数据、集合运算

```python

from typing import Set

unique_ids: Set[int] = {1, 2, 3} # 整型集合

tags: Set[Union[str, int]] = {"urgent", 1001} # 混合类型集合

```

* 任意类型 `Any`

- 动态类型占位符,放弃类型检查, 应尽量避免过度使用

- 适用场景:兼容无类型代码或动态行为

```python

from typing import Any

def debug_log(obj: Any) -> None:

print(repr(obj))

```

* 函数类型注解

* 为函数添加typing模块的注解后,函数使用者就能清晰的了解函数的参数以及返回值类型

```python

def greet(name: str) -> str: # 参数类型 -> 返回值类型

return f"Hello, {name}"

def calculate(a: int, b: int) -> int:

return a * b

# 无返回值使用None

def show_info(info: str) -> None:

print(info)

```

* `Literal` 字面量类型

* 精确值类型约束, 替代简单字符串枚举

* 适用场景:枚举值的类型安全

```python

from typing import Literal

# 限定特定值

HttpMethod = Literal["GET", "POST", "PUT", "DELETE"]

def send_request(method: HttpMethod, url: str) -> None:

print(f"Sending {method} request to {url}")

send_request("POST", "/api") # ✅

send_request("PATCH", "/api") # ❌ mypy报错

```

* `Union`联合类型

* Union允许参数接受多种不同类型的数据。

* 例如 `Union[int, float]`表示变量可以是int类型或float类型

```python

from typing import Union

def process_input(value: Union[int, str]) -> None:

if isinstance(value, int):

print(f"Number: {value}")

else:

print(f"String: {value}")

process_input(42) # Number: 42

process_input("test") # String: test

```

* `Optional`可选类型

* `Optional`表示参数可以是指定类型或者`None`

* 让编译器识别到该参数有一个类型提示,可以使指定类型,也可以是None,且参数是可选非必传的。

* `Optional[int]` 等价于 `Union[int, None]`,表示:既可以传指定的类型 int,也可以传 None, `Optional[ ]` 里面只能写一个数据类型

* 适用场景:可能返回空值的操作

* 在下面函数定义中,Optional[str] = None表示参数name的类型可以是str或None。

* 注意

* `= None`可省略,它表示默认参数。

* 从 Python 3.10 开始,Optional[Type] 可以直接用 `Type | None` 替代,写法更清晰

```python

from typing import Optional

def greet1(name: Optional[str] = None) -> str:

if name:

return f"Hello, {name}!"

else:

return "Hello, world!"

def greet2(name: Optional[str]) -> str:

if name:

return f"Hello, {name}!"

else:

return "Hello, world!"

print(greet1())

# print(greet2()) # 报错,必须要有参数

print(greet1("老王"))

print(greet2("冰冰"))

```

* 类型别名

* 自定义类型别名提高代码可读性。

```python

from typing import Tuple

# 基本别名

UserId = int

Point = Tuple[float, float]

def get_user(id: UserId) -> str:

return f"User{id}"

def plot(points: List[Point]) -> None:

for x, y in points:

print(f"({x}, {y})")

```

* `NewType`新类型创建

* 创建具有类型检查的语义化新类型

* 适合 区分相同基础类型的不同用途

```python

from typing import NewType

# 创建强类型

UserId = NewType('UserId', int)

admin_id = UserId(1001)

def print_id(user_id: UserId) -> None:

print(user_id)

# 正确调用

print_id(admin_id) # ✅

print_id(1001) # ❌ mypy报错

```

* `TypeVar`(类型变量)

* 创建通用类型参数

* 适用场景:泛型函数/类的类型参数化;比如创建一个函数,无论是处理整数、字符串还是自定义对象

```python

from typing import TypeVar, Sequence

T = TypeVar('T') # 无约束类型

Num = TypeVar('Num', int, float) # 受限类型

def first(items: Sequence[T]) -> T:

return items[0]

def sum(values: Sequence[Num]) -> Num:

return sum(values)

```

```python

from typing import TypeVar

# 定义一个泛型变量T

T = TypeVar('T')

# 创建一个泛型函数

def get_first_item(items: list[T]) -> T:

"""获取列表的第一个元素"""

if items:

return items[0]

raise ValueError("列表为空")

# 使用示例

numbers = [1, 2, 3, 4, 5]

words = ['apple', 'banana', 'cherry', 'fruit']

print(get_first_item(numbers)) # 输出: 1

print(get_first_item(words)) # 输出: apple

```

### Prompt提示词工程和案例最佳实践

#### 大模型必备Prompt提示词工程

* 什么是Prompt Engineering提示词工程

* 通过特定格式的文本输入引导AI模型生成期望输出的技术,明确地告诉模型你想要解决的问题或完成的任务

* 也是大语言模型理解用户需求并生成相关、准确回答或内容的基础

* **类比:给Java程序员的任务需求文档(越清晰明确,结果越符合预期)**

* 为什么需要学习?

* 大模型就是你的员工,你可以有多个助手,OpenAI、DeepSeek、千问等

* 作为老板的你,需要正确的下达任务,描述合理和交付目标等

```python

传统编程:写代码→计算机执行

Prompt工程:写自然语言指令→大模型生成结果

```

* Prompt设计四要素

* 角色设定(Role Prompting)

* 作用:限定模型回答视角

```python

[差] 写一首关于春天的诗

[优] 你是一位擅长写现代诗的诗人,请用比喻手法创作一首8行的春天主题短诗

```

* 任务描述

* STAR原则:Situation 场景、Task 任务、Action 行动、Result 结果

```python

(场景)用户提交了一个技术问题

(任务)需要给出准确且易懂的解答

(行动)分步骤说明解决方案

(结果)最后用一句话总结要点

```

* 格式规范

* 常用格式指令:分点列表、指定段落数、表格呈现、代码格式

```python

用JSON格式输出包含以下字段:

{

"summary": "不超过50字的摘要",

"keywords": ["关键词1", "关键词2", "关键词3"]

}

```

* 约束条件

* 常见约束类型:

| 类型 | 示例 |

| :--: | :--------------------: |

| 长度 | "答案控制在200字内" |

| 风格 | "用初中生能理解的语言" |

| 内容 | "不包含专业术语" |

| 逻辑 | "先解释概念再举例说明" |

* 汇总

| 要素 | 说明 | 反面案例 | 优化案例 |

| :----------: | :------------: | :----------: | :-------------------------: |

| **角色设定** | 明确模型身份 | "帮我写代码" | "你是一个资深Java架构师..." |

| **任务说明** | 具体执行要求 | "分析数据" | "使用Markdown表格对比..." |

| **输出格式** | 结构化结果定义 | 自由文本 | JSON/XML/YAML格式 |

| **约束条件** | 限制输出范围 | 无限制 | "不超过200字,不用专业术语" |

* 模板结构设计(黄金公式)

```python

# 标准三段式结构

prompt_template = """

[角色设定]

你是一个具有10年经验的{领域}专家,擅长{特定技能}

[任务说明]

需要完成以下任务:

1. {步骤1}

2. {步骤2}

3. {步骤3}

[输出要求]

请按照以下格式响应:

{示例格式}

"""

```

* 常见问题和排查原因

| 现象 | 可能原因 | 解决方案 |

| :--------------: | :----------------: | :----------------------: |

| 输出内容偏离主题 | 角色设定不明确 | 添加"忽略无关信息"约束 |

| 生成结果过于笼统 | 缺少具体步骤要求 | 添加"分步骤详细说明"指令 |

| 格式不符合要求 | 未提供明确格式示例 | 添加XML/JSON标记示例 |

#### Prompt提示词工程多案例最佳实践

* 需求

* 利用在线大模型或者本地大模型

* 测试不同的提示词效果,分析优化前、后的Prompt工程

* **案例实战:通用回答助手、代码生成助手、技术问答、AI数据分析 等案例实战**

* 案例实战一:通用回答

* 差Prompt:

```

告诉我关于人工智能的信息

```

* 问题分析:过于宽泛,缺乏焦点、没有指定回答的深度和范围、未明确期望的格式

* 输出结果:可能得到从历史发展到技术原理的冗长概述,缺乏针对性

* 好prompt

```python

你是一位科技专栏作家,请用通俗易懂的方式向高中生解释:

1. 什么是人工智能(用1个生活化比喻说明)

2. 列举3个当前主流应用场景

3. 字数控制在300字以内

要求使用「首先」、「其次」、「最后」的结构

```

* 优化后

* 设定回答视角(科技专栏作家)

* 明确目标受众(高中生)

* 结构化输出要求

* 添加格式约束

* 案例实战二:代码生成

* 差Prompt:

```python

写个Python程序

```

* 问题分析:没有具体功能描述、未指定输入输出格式、忽略异常处理需求

* 输出结果:可能生成简单的"Hello World"程序,与真实需求不符

* 好Prompt:

```python

编写一个Python函数,实现以下功能:

- 输入:字符串形式的日期(格式:YYYY-MM-DD)

- 输出:该日期对应的季度(1-4)

- 要求:

- 包含参数校验(不符合格式时抛出ValueError)

- 使用datetime模块

- 编写对应的单元测试用例

示例:

输入 "2024-03-15" → 返回 1

```

* 优化后

* 明确定义输入输出

* 指定实现方式

* 包含测试要求

* 提供示例验证

* 案例实战三:技术问答

* 差Prompt

```python

如何优化网站性能?

```

* 问题分析:问题范围过大、未说明技术栈、缺少评估标准

* 输出结果:可能得到泛泛而谈的通用建议

* 好Prompt

```python

针对使用SpringBoot+Vue3的技术栈,请给出5项可量化的性能优化方案:

要求:

1. 每项方案包含:

- 实施步骤

- 预期性能提升指标(如LCP减少20%)

- 复杂度评估(低/中/高)

2. 优先前端和后端优化方案

3. 引用Web Vitals评估标准

限制条件:

- 不涉及服务器扩容等硬件方案

- 排除已广泛采用的方案(如代码压缩)

```

* 优化点

* 限定技术范围

* 结构化响应要求

* 设定评估标准

* 排除已知方案

* 案例实战四:数据分析

* 差Prompt

```python

分析这份销售数据

```

* 问题分析:未说明数据特征、没有指定分析方法、缺少可视化要求

* 输出结果:可能得到无重点的描述性统计,缺乏洞察

* 好Prompt

```python

你是一位资深数据分析师,请完成以下任务:

数据集特征:

- 时间范围:2027年1-12月

- 字段:日期/产品类别/销售额/利润率

要求:

1. 找出销售额top3的月份,分析增长原因

2. 识别利润率低于5%的产品类别

3. 生成包含趋势图的Markdown报告

输出格式:

## 分析报告

### 关键发现

- 要点1(数据支撑)

- 要点2(对比分析)

### 可视化

趋势图描述,生成base64编码的折线图

```

* 优化点:

* 明确分析者角色

* 描述数据集特征

* 指定分析方法论

* 规范输出格式

#### LangChain 提示模板PromptTemplate介绍

* 需求

* 掌握LangChain 提示模板PromptTemplate常见用法

* 掌握提示词里面的占位符使用和预置变量

* PromptTemplate介绍

* 是LangChain中用于构建结构化提示词的组件,负责将用户输入/动态数据转换为LLM可理解的格式

* 它是一种单纯的字符模板,后续还有进阶的ChatPromptTemplate

* 主要解决

* 动态内容组装

* 避免Prompt硬编码

* PromptTemplate核心变量和方法

* template 定义具体的模板格式,其中 `{变量名}` 是占位符

* input_variables 定义模板中可以使用的变量。

* partial_variables:前置变量,可以提前定义部分变量的值,预填充进去

* format 使用 `format` 方法填充模板中的占位符,形成最终的文本

* 案例实战

* 创建PromptTemplate对象简单模版

```python

from langchain.prompts import PromptTemplate

# 定义模板

template = """

你是一位专业的{domain}顾问,请用{language}回答:

问题:{question}

回答:

"""

# 创建实例

prompt = PromptTemplate(

input_variables=["domain", "language", "question"],

template=template

)

print(prompt)

# 格式化输出

print(prompt.format(

domain="网络安全",

language="中文",

question="如何防范钓鱼攻击?"

))

```

* 自动推断变量

```python

from langchain.prompts import PromptTemplate

# 当不显式声明 input_variables 时

template = "请将以下文本翻译成{target_language}:{text}"

prompt = PromptTemplate.from_template(template)

print(prompt.input_variables) # 输出: ['target_language', 'text']

```

* 默认值设置

```python

from langchain.prompts import PromptTemplate

template = """分析用户情绪(默认分析类型:{analysis_type}):

用户输入:{user_input}

分析结果:"""

prompt_template = PromptTemplate(

input_variables=["user_input"],

template=template,

template_format="f-string", # 新增参数

partial_variables={"analysis_type": "情感极性分析"} # 固定值

)

print(prompt_template.format(user_input="这个产品太难用了"))

#====打印内部的变量======

print(prompt_template.template)

print(prompt_template.input_variables)

print(prompt_template.template_format)

print(prompt_template.input_types)

print(prompt_template.partial_variables)

```

#### PromptTemplate结合LLM案例实战

* 案例实战

```python

from langchain_openai import ChatOpenAI

from langchain_core.prompts import PromptTemplate

from langchain_core.output_parsers import StrOutputParser

#创建prompt AIGC

prompt_template = PromptTemplate(

input_variables=["product"],

template="为{product}写3个吸引人的广告语,需要面向年轻人",

)

prompt = prompt_template.invoke({"product":"小滴课堂"})

#创建模型

model = ChatOpenAI(

model_name = "qwen-plus",

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",

api_key="sk-005c3c25f6d042848b29d75f2f020f08",

temperature=0.7

)

#调用大模型

response = model.invoke(prompt)

#print(response.content)

#创建输出解析器

out_parser = StrOutputParser()

answer = out_parser.invoke(response)

print(answer)

```

#### 大模型ChatModel聊天模型和Token计算

* 什么是**ChatModel**

* 是专为**多轮对话场景**设计的大语言模型(LLM),通过理解上下文和对话逻辑,生成连贯、符合人类交互习惯的回复。

* 不仅是简单的文本生成工具,更是能处理复杂对话流程的智能系统

* 核心特点

| 特性 | 说明 | 示例场景 |

| :--------------: | :----------------------------------------------: | :----------------------------------------------------------: |

| **上下文感知** | 追踪多轮对话历史,理解指代关系(如“它”、“这个”) | 用户:“什么是量子计算?” → AI 解释 → 用户:“它有什么应用?” → AI 能正确关联“它”指量子计算 |

| **角色扮演能力** | 可设定特定角色(如客服、教师)并保持一致性 | 设定AI为“医疗助手”时,拒绝提供诊断建议,仅提供健康信息 |

| **意图识别** | 解析用户深层需求(如咨询、投诉、闲聊) | 用户:“我的订单没收到!” → AI 识别为物流投诉,优先转接人工客服 |

| **情感分析** | 识别用户情绪(积极/消极),调整回复语气 | 用户表达不满时,AI 回复:“非常抱歉给您带来不便,我们会立刻处理...” |

| **安全过滤** | 避免生成有害、偏见或敏感内容 | 用户请求生成暴力内容时,AI 拒绝并提示:“我无法协助这个请求” |

* ChatModel vs. 传统 Text Model

| **对比维度** | **ChatModel** | **传统 Text Model(如 text-davinci-003)** |

| :------------: | :------------------------------------: | :----------------------------------------: |

| **核心目标** | 多轮交互式对话 | 单次文本生成(文章、代码等) |

| **输入格式** | 结构化消息序列(System/Human/AI 角色) | 纯文本提示 |

| **上下文处理** | 自动管理对话历史 | 需手动拼接历史文本 |

| **输出控制** | 内置安全审查和格式约束 | 依赖提示词工程控制 |

| **典型应用** | 客服机器人、虚拟助手 | 内容创作、数据清洗 |

* 聊天模型(如 GPT-3.5-turbo、GPT-4)通过 **角色化消息** 实现对话控制,核心角色包括:

| 角色类型 | 标识符 | 功能定位 | 使用场景示例 |

| :-----------: | :---------: | :------------------------: | :----------------------------------------------------------: |

| **System** | `system` | 定义AI的行为准则和角色设定 | 设定AI身份、回答规则、知识范围

* LangSmith

* 开发者调试与监控平台,支持对LLM应用的性能分析、测试和部署优化

* 提供可视化调试界面和自动化评估工具,提升开发效率与可靠性

* LangGraph

* 状态管理工具,用于构建多代理系统,支持流式处理和复杂任务分解

* 可视化流程设计器, 循环/条件分支支持,分布式状态持久化, 自动断点续跑

* 产品矩阵对比

| **产品** | **核心价值** | **Java生态对标** | **适用场景** |

| :------------: | :----------------: | :------------------: | :----------------------: |

| LangSmith | 全生命周期可观测性 | Prometheus + Grafana | 生产环境监控、效果评估 |

| LangServe | 快速服务化 | Spring Boot | 模型API部署、快速原型 |

| LangGraph | 复杂流程编排 | Activiti BPMN | 业务工作流设计、状态管理 |

| LangChain Core | 基础组件库 | Spring AI | 基础AI功能开发 |

#### Python虚拟环境evn应用讲解和实战

* 什么是Python的虚拟环境

* 类似虚拟机、沙箱机制一样,隔离不同的项目依赖的环境

* 核心作用

* **隔离项目依赖**:不同项目可能依赖同一库的不同版本。

* **避免全局污染**:防止安装过多全局包导致冲突。

* **便于协作**:通过依赖清单(如`requirements.txt`)复现环境

* 虚拟环境 vs 全局环境

| **特性** | **虚拟环境** | **全局环境** |

| :----------: | :--------------------------: | :------------------------: |

| **依赖隔离** | 项目独立,互不影响 | 所有项目共享 |

| **安全性** | 避免权限问题(无需sudo安装) | 需谨慎操作(可能影响系统) |

| **适用场景** | 开发、测试、多版本项目 | 系统级工具或少量通用库 |

* 镜像源配置

* 查看系统配置的镜像源操作

```shell

pip config list

pip config get global.index-url

```

* 配置国内镜像源

```shell

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

```

* 虚拟环境基础操作

* 创建虚拟环境

```shell

# 语法:python -m venv <环境目录名>

python -m venv myenv # 创建名为myenv的虚拟环境

```

* 激活虚拟环境

* Windows(CMD/PowerShell)

```shell

myenv\Scripts\activate.bat # CMD

myenv\Scripts\Activate.ps1 # PowerShell(需管理员权限解除限制)

```

* Linux/macOS:

```shell

source myenv/bin/activate

```

* 激活后提示符变化

```shell

source myenv/bin/activate

```

* 退出虚拟环境

```shell

deactivate

```

* 依赖管理

* 安装库到虚拟环境

```shell

# 激活环境后操作

(myenv) pip install requests # 安装最新版本

(myenv) pip install django==3.2 # 安装指定版本

```

* 导出依赖清单

```shell

(myenv) pip freeze > requirements.txt

```

* 从清单恢复依赖

```shell

# 在新环境中执行

(myenv) pip install -r requirements.txt

```

* 最佳实践与案例

* 典型项目流程(区分Linux、Mac和Window)

```shell

# 创建项目目录并进入

mkdir myproject && cd myproject

# 创建虚拟环境

python -m venv .venv

# 激活环境(Windows: .venv\Scripts\activate)

source .venv/bin/activate

# 安装依赖

pip install django pandas

# 导出依赖

pip freeze > requirements.txt

# 开发完成后退出

deactivate

```

* 协作复现环境

```shell

# 克隆项目后操作

git clone https://github.com/user/project.git

cd project

# 创建并激活虚拟环境

python -m venv .venv

source .venv/bin/activate

# 安装依赖

pip install -r requirements.txt

```

* 常见问题与解决

* 虚拟环境激活失败

* 现象:source: command not found

* 原因:在Windows使用Linux命令或在Linux未使用source。

* 解决:根据操作系统选择正确激活命令。

* 跨平台路径问题

* 问题:Windows与Linux路径格式差异导致脚本无法运行。

* 方案:使用/统一路径分隔符,或在代码中处理路径

* 依赖版本冲突

* 场景:项目A需要`numpy==1.18`,项目B需要`numpy==1.20`。

* 解决:为每个项目创建独立虚拟环境。

* 案例实战:

* LangChain框架环境搭建

#### VSCode编辑器LangChain环境安装和验证

* Python虚拟环境和项目创建

* 创建虚拟环境(Windows/macOS/Linux通用)

```python

# 创建环境目录

python -m venv langchain_env

```

* 激活虚拟环境

* **Windows**

```python

.\langchain_env\Scripts\activate

```

* **macOS/Linux**

```python

source langchain_env/bin/activate

```

* 验证环境

```python

# 查看Python路径(应显示虚拟环境路径)

which python # macOS/Linux

where python # Windows

```

* LangChain环境安装

* 安装核心依赖包 (**版本和课程保持一致,不然很多不兼容!!!**)

* 下载相关资料 ,使用**【wget】或者【浏览器】远程下载相关依赖包(需要替换群里最新的)**

```python

原生资料下载方式(账号 - 密码 - ip地址 - 端口 需要替换群里最新的,【其他路径不变】)

wget --http-user=用户名 --http-password=密码 http://ip:端口/dcloud_pan/aipan_install_1.zip

#比如 命令行下

wget --http-user=admin --http-password=xdclass.net888 http://47.115.31.28:9088/dcloud_pan/aipan_install_1.zip

# 比如 浏览器直接访问

http://47.115.31.28:9088/dcloud_pan/aipan_install_1.zip

```

* 解压后执行【**依赖很多,版本差异大,务必按照下面执行,否则课程无法进行下去,加我微信 xdclass6**】

```python

# 安装依赖

pip install -r requirements.txt

```

* 验证安装【很多模块后续使用会验证】

```python

# 执行简单测试

from langchain_core.prompts import ChatPromptTemplate

print(ChatPromptTemplate.from_template("Hello 欢迎来到小滴课堂-AI大模型开发课程 {title}!").format(title=",干就完了"))

# 应输出: Human: Hello 欢迎来到小滴课堂-AI大模型开发课程 ,干就完了!

```

#### LangChain框架模块和大模型IO交互链路讲解

**简介: LangChain框架模块和大模型IO交互链路讲解**

* 大模型IO交互链路概览

* LangChain模块对比大家熟知的Java Spring生态

| LangChain模块 | Spring对应技术 | 交互方式差异 |

| :-----------: | :-------------: | :----------------: |

| Models | Spring AI | 多模型热切换支持 |

| Memory | Redis/Hazelcast | 内置对话上下文管理 |

| Chains | Activity工作流 | 动态流程重组能力 |

| Agents | Drools规则引擎 | 基于LLM的决策机制 |

* LangChain架构六大模块(后续围绕模块逐步深入)

* **Models(模型层)**

- 相当于`interface LLM`,支持多种大模型(OpenAI/Gemini等)

- 示例:就像Java中的JDBC接口,可以对接不同数据库

* **Prompts(提示工程)**

- 相当于模板引擎(类似Thymeleaf)

```python

from langchain.prompts import PromptTemplate

template = """

你是一个Java专家,请用比喻解释{concept}:

要求:

1. 用{framework}框架做类比

2. 不超过2句话

"""

prompt = PromptTemplate.from_template(template)

print(prompt.format(concept="机器学习", framework="Spring"))

```

* **Chains(任务链)**

- 类似Java的工作流引擎,将多个组件组合在一起,创建一个单一、连贯的任务

- 包括不同的链之间组合

```python

from langchain.chains import LLMChain

# 创建任务链(类似Java的链式调用)

chain = LLMChain(llm=model, prompt=prompt)

result = chain.run(concept="多线程", framework="Spring Batch")

```

* **Memory(记忆)**

- 类似HTTP Session的会话管理

```python

from langchain.memory import ConversationBufferMemory

memory = ConversationBufferMemory()

memory.save_context({"input": "你好"}, {"output": "您好!"})

```

* **Indexes(索引)**

- 类似数据库索引+JDBC连接

- 对不通的文档进行结构化的方法,包括提取、切割、向量存储等,方便 LLM 能够更好的与之交互

```python

from langchain.document_loaders import WebBaseLoader

# 加载外部数据(类似JDBC读取数据库)

loader = WebBaseLoader("https://docs.spring.io/spring-boot/docs/current/reference/html/")

docs = loader.load()

```

* **Agents(智能体)**

- 类似策略模式+工厂模式,比chain更高级,可以自己选择调用链路

- 比如下一步有多个选择, 包括不同工具、流程链路等,由程序自己选择

```python

from langchain.agents import Tool, initialize_agent

tools = [

Tool(name="Calculator",

func=lambda x: eval(x),

description="计算数学表达式")

]

agent = initialize_agent(tools, llm, agent="zero-shot-react-description")

```

* 常见分层设计和交互如下

```python

+----------------+

| 应用层 (Agents) |

+----------------+

| 编排层 (Chains) |

+----------------+

| 能力层 (Tools) |

+----------------+

| 模型层 (Models) |

+----------------+

| 数据层 (Memory) |

+----------------+

```

#### 大模型Model-IO链路抽象和Chat模型开发

**简介: 大模型Model-IO链路抽象和Chat模型实战**

* 大模型使用开发的Model IO链路核心三要素

| 组件 | 作用 | 典型类/方法 |

| :---------: | :------------------------: | :-------------------------------------------: |

| **Prompts** | 构建模型输入的结构化模板 | `ChatPromptTemplate`, `FewShotPromptTemplate` |

| **Models** | 对接不同LLM服务的统一接口 | `ChatOpenAI` |

| **Parsers** | 将模型输出转换为结构化数据 | `StrOutputParser`, `JsonOutputParser` |

* LangChain支持的模型类型说明

* 文本生成模型(Text Generation Models-逐渐少用了,Chat更强大)

* 功能:生成连贯文本,主要用于处理文本相关的任务,如自然语言理解、文本生成、情感分析、翻译

* 典型模型:GPT-3、Claude、PaLM

* 对话模型(Chat Models,多数采用这个)

* 功能:处理多轮对话,人机交互中的对话能力,能够进行自然流畅的对话交流,适用于客户服务、智能助手

* 典型模型:GPT-4、Claude-2

* 嵌入模型(Embedding Models)

* 功能:生成文本向量表示,将文本转换为固定长度的向量表示,向量保留了数据的语义信息,便于后续的相似度计算、分类等任务。

* 典型模型:text-embedding-ada-002

* 多模态模型(Multimodal Models)

* 功能:处理文本+图像,例如文本、图像、音频等,更全面的信息理解和处理能力。

* 典型模型:GPT-4V、Qwen-omni-turbo

* 其他更多....

* LangChain开发LLM聊天模型快速编码实战

```python

from langchain_openai import ChatOpenAI

# 调用Chat Completion API

llm = ChatOpenAI(

model_name='qwen-plus',

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",

api_key="sk-0903038424424850a88ed161845d7d4c")

response = llm.invoke('你是谁?')

print(response)

```

#### 类型增强模块Typing应用和案例》

* Python的动态类型痛点

```python

# 传统动态类型代码示例

def calculate(a, b):

return a + b # 无法直观看出参数类型和返回值类型

result1 = calculate(3, 5) # ✅ 正确用法

result2 = calculate("3", 5) # ❌ 运行时才报错

```

* 什么是Typing模块

* 自python3.5开始,PEP484为python引入了类型注解(type hints), 为Python带来了类型提示和类型检查的能力。

* 允许开发者在代码中添加类型注解,提高代码的可读性和可维护性。

* 尽管Python是一种动态类型语言,但类型注解能让开发者更清晰地了解函数和变量的预期类型

* 核心

* **提升代码可读性**:明确参数和返回类型

* **增强IDE支持**:智能提示与自动补全

* **静态类型检查**:开发阶段发现潜在错误

* **完善文档生成**:自动生成类型化API文档

* 核心语法快速入门

* 简单类型(Primitive Types)

* Python内置的基本数据类型注解

* 适用场景:变量、函数参数、返回值的简单类型声明

* 类型注解不影响运行时行为

* 兼容子类型(如int注解可接受bool值)

```

age: int = 25 # 整数类型

name: str = "Alice" # 字符串类型

price: float = 9.99 # 浮点数类型

is_valid: bool = True # 布尔类型

data: bytes = b"binary" # 字节类型

```

* 容器类型

* 有多种内置的类型别名,比如`List`、`Tuple`、`Dict`等,可用于注解变量和函数的预期类型

* 例如

* `Dict[str, int]`表示键是字符串类型,值是整数类型的字典

* `Set[int]`表示整数类型的集合

* `List`同质元素的序列容器

* 适用场景:列表类型数据,元素类型相同

```python

from typing import List

scores: List[int] = [90, 85, 95] # 整型列表

matrix: List[List[float]] = [[1.1, 2.2], [3.3]] # 嵌套列表

```

* `Dict` 键值对映射容器

* 适用场景:字典类型数据,需指定键值类型

```python

from typing import Dict

person: Dict[str, str] = {"name": "Bob", "job": "dev"} # 字符串字典

config: Dict[str, Union[int, str]] = {"timeout": 30} # 混合值类型

```

* `Tuple`固定长度、类型的不可变序列

- 适用场景:坐标、数据库记录等固定结构

- 变长声明:`Tuple[T, ...]`:元素类型相同但长度不限 , ():空元组

```python

from typing import Tuple

point: Tuple[float, float] = (3.14, 2.71) # 二元坐标

rgb: Tuple[int, int, int] = (255, 0, 128) # 颜色值

flexible: Tuple[str, ...] = ("a", "b", "c") # 任意长度元组

```

* `Set` 无序不重复元素的集合

- 适用场景:去重数据、集合运算

```python

from typing import Set

unique_ids: Set[int] = {1, 2, 3} # 整型集合

tags: Set[Union[str, int]] = {"urgent", 1001} # 混合类型集合

```

* 任意类型 `Any`

- 动态类型占位符,放弃类型检查, 应尽量避免过度使用

- 适用场景:兼容无类型代码或动态行为

```python

from typing import Any

def debug_log(obj: Any) -> None:

print(repr(obj))

```

* 函数类型注解

* 为函数添加typing模块的注解后,函数使用者就能清晰的了解函数的参数以及返回值类型

```python

def greet(name: str) -> str: # 参数类型 -> 返回值类型

return f"Hello, {name}"

def calculate(a: int, b: int) -> int:

return a * b

# 无返回值使用None

def show_info(info: str) -> None:

print(info)

```

* `Literal` 字面量类型

* 精确值类型约束, 替代简单字符串枚举

* 适用场景:枚举值的类型安全

```python

from typing import Literal

# 限定特定值

HttpMethod = Literal["GET", "POST", "PUT", "DELETE"]

def send_request(method: HttpMethod, url: str) -> None:

print(f"Sending {method} request to {url}")

send_request("POST", "/api") # ✅

send_request("PATCH", "/api") # ❌ mypy报错

```

* `Union`联合类型

* Union允许参数接受多种不同类型的数据。

* 例如 `Union[int, float]`表示变量可以是int类型或float类型

```python

from typing import Union

def process_input(value: Union[int, str]) -> None:

if isinstance(value, int):

print(f"Number: {value}")

else:

print(f"String: {value}")

process_input(42) # Number: 42

process_input("test") # String: test

```

* `Optional`可选类型

* `Optional`表示参数可以是指定类型或者`None`

* 让编译器识别到该参数有一个类型提示,可以使指定类型,也可以是None,且参数是可选非必传的。

* `Optional[int]` 等价于 `Union[int, None]`,表示:既可以传指定的类型 int,也可以传 None, `Optional[ ]` 里面只能写一个数据类型

* 适用场景:可能返回空值的操作

* 在下面函数定义中,Optional[str] = None表示参数name的类型可以是str或None。

* 注意

* `= None`可省略,它表示默认参数。

* 从 Python 3.10 开始,Optional[Type] 可以直接用 `Type | None` 替代,写法更清晰

```python

from typing import Optional

def greet1(name: Optional[str] = None) -> str:

if name:

return f"Hello, {name}!"

else:

return "Hello, world!"

def greet2(name: Optional[str]) -> str:

if name:

return f"Hello, {name}!"

else:

return "Hello, world!"

print(greet1())

# print(greet2()) # 报错,必须要有参数

print(greet1("老王"))

print(greet2("冰冰"))

```

* 类型别名

* 自定义类型别名提高代码可读性。

```python

from typing import Tuple

# 基本别名

UserId = int

Point = Tuple[float, float]

def get_user(id: UserId) -> str:

return f"User{id}"

def plot(points: List[Point]) -> None:

for x, y in points:

print(f"({x}, {y})")

```

* `NewType`新类型创建

* 创建具有类型检查的语义化新类型

* 适合 区分相同基础类型的不同用途

```python

from typing import NewType

# 创建强类型

UserId = NewType('UserId', int)

admin_id = UserId(1001)

def print_id(user_id: UserId) -> None:

print(user_id)

# 正确调用

print_id(admin_id) # ✅

print_id(1001) # ❌ mypy报错

```

* `TypeVar`(类型变量)

* 创建通用类型参数

* 适用场景:泛型函数/类的类型参数化;比如创建一个函数,无论是处理整数、字符串还是自定义对象

```python

from typing import TypeVar, Sequence

T = TypeVar('T') # 无约束类型

Num = TypeVar('Num', int, float) # 受限类型

def first(items: Sequence[T]) -> T:

return items[0]

def sum(values: Sequence[Num]) -> Num:

return sum(values)

```

```python

from typing import TypeVar

# 定义一个泛型变量T

T = TypeVar('T')

# 创建一个泛型函数

def get_first_item(items: list[T]) -> T:

"""获取列表的第一个元素"""

if items:

return items[0]

raise ValueError("列表为空")

# 使用示例

numbers = [1, 2, 3, 4, 5]

words = ['apple', 'banana', 'cherry', 'fruit']

print(get_first_item(numbers)) # 输出: 1

print(get_first_item(words)) # 输出: apple

```

### Prompt提示词工程和案例最佳实践

#### 大模型必备Prompt提示词工程

* 什么是Prompt Engineering提示词工程

* 通过特定格式的文本输入引导AI模型生成期望输出的技术,明确地告诉模型你想要解决的问题或完成的任务

* 也是大语言模型理解用户需求并生成相关、准确回答或内容的基础

* **类比:给Java程序员的任务需求文档(越清晰明确,结果越符合预期)**

* 为什么需要学习?

* 大模型就是你的员工,你可以有多个助手,OpenAI、DeepSeek、千问等

* 作为老板的你,需要正确的下达任务,描述合理和交付目标等

```python

传统编程:写代码→计算机执行

Prompt工程:写自然语言指令→大模型生成结果

```

* Prompt设计四要素

* 角色设定(Role Prompting)

* 作用:限定模型回答视角

```python

[差] 写一首关于春天的诗

[优] 你是一位擅长写现代诗的诗人,请用比喻手法创作一首8行的春天主题短诗

```

* 任务描述

* STAR原则:Situation 场景、Task 任务、Action 行动、Result 结果

```python

(场景)用户提交了一个技术问题

(任务)需要给出准确且易懂的解答

(行动)分步骤说明解决方案

(结果)最后用一句话总结要点

```

* 格式规范

* 常用格式指令:分点列表、指定段落数、表格呈现、代码格式

```python

用JSON格式输出包含以下字段:

{

"summary": "不超过50字的摘要",

"keywords": ["关键词1", "关键词2", "关键词3"]

}

```

* 约束条件

* 常见约束类型:

| 类型 | 示例 |

| :--: | :--------------------: |

| 长度 | "答案控制在200字内" |

| 风格 | "用初中生能理解的语言" |

| 内容 | "不包含专业术语" |

| 逻辑 | "先解释概念再举例说明" |

* 汇总

| 要素 | 说明 | 反面案例 | 优化案例 |

| :----------: | :------------: | :----------: | :-------------------------: |

| **角色设定** | 明确模型身份 | "帮我写代码" | "你是一个资深Java架构师..." |

| **任务说明** | 具体执行要求 | "分析数据" | "使用Markdown表格对比..." |

| **输出格式** | 结构化结果定义 | 自由文本 | JSON/XML/YAML格式 |

| **约束条件** | 限制输出范围 | 无限制 | "不超过200字,不用专业术语" |

* 模板结构设计(黄金公式)

```python

# 标准三段式结构

prompt_template = """

[角色设定]

你是一个具有10年经验的{领域}专家,擅长{特定技能}

[任务说明]

需要完成以下任务:

1. {步骤1}

2. {步骤2}

3. {步骤3}

[输出要求]

请按照以下格式响应:

{示例格式}

"""

```

* 常见问题和排查原因

| 现象 | 可能原因 | 解决方案 |

| :--------------: | :----------------: | :----------------------: |

| 输出内容偏离主题 | 角色设定不明确 | 添加"忽略无关信息"约束 |

| 生成结果过于笼统 | 缺少具体步骤要求 | 添加"分步骤详细说明"指令 |

| 格式不符合要求 | 未提供明确格式示例 | 添加XML/JSON标记示例 |

#### Prompt提示词工程多案例最佳实践

* 需求

* 利用在线大模型或者本地大模型

* 测试不同的提示词效果,分析优化前、后的Prompt工程

* **案例实战:通用回答助手、代码生成助手、技术问答、AI数据分析 等案例实战**

* 案例实战一:通用回答

* 差Prompt:

```

告诉我关于人工智能的信息

```

* 问题分析:过于宽泛,缺乏焦点、没有指定回答的深度和范围、未明确期望的格式

* 输出结果:可能得到从历史发展到技术原理的冗长概述,缺乏针对性

* 好prompt

```python

你是一位科技专栏作家,请用通俗易懂的方式向高中生解释:

1. 什么是人工智能(用1个生活化比喻说明)

2. 列举3个当前主流应用场景

3. 字数控制在300字以内

要求使用「首先」、「其次」、「最后」的结构

```

* 优化后

* 设定回答视角(科技专栏作家)

* 明确目标受众(高中生)

* 结构化输出要求

* 添加格式约束

* 案例实战二:代码生成

* 差Prompt:

```python

写个Python程序

```

* 问题分析:没有具体功能描述、未指定输入输出格式、忽略异常处理需求

* 输出结果:可能生成简单的"Hello World"程序,与真实需求不符

* 好Prompt:

```python

编写一个Python函数,实现以下功能:

- 输入:字符串形式的日期(格式:YYYY-MM-DD)

- 输出:该日期对应的季度(1-4)

- 要求:

- 包含参数校验(不符合格式时抛出ValueError)

- 使用datetime模块

- 编写对应的单元测试用例

示例:

输入 "2024-03-15" → 返回 1

```

* 优化后

* 明确定义输入输出

* 指定实现方式

* 包含测试要求

* 提供示例验证

* 案例实战三:技术问答

* 差Prompt

```python

如何优化网站性能?

```

* 问题分析:问题范围过大、未说明技术栈、缺少评估标准

* 输出结果:可能得到泛泛而谈的通用建议

* 好Prompt

```python

针对使用SpringBoot+Vue3的技术栈,请给出5项可量化的性能优化方案:

要求:

1. 每项方案包含:

- 实施步骤

- 预期性能提升指标(如LCP减少20%)

- 复杂度评估(低/中/高)

2. 优先前端和后端优化方案

3. 引用Web Vitals评估标准

限制条件:

- 不涉及服务器扩容等硬件方案

- 排除已广泛采用的方案(如代码压缩)

```

* 优化点

* 限定技术范围

* 结构化响应要求

* 设定评估标准

* 排除已知方案

* 案例实战四:数据分析

* 差Prompt

```python

分析这份销售数据

```

* 问题分析:未说明数据特征、没有指定分析方法、缺少可视化要求

* 输出结果:可能得到无重点的描述性统计,缺乏洞察

* 好Prompt

```python

你是一位资深数据分析师,请完成以下任务:

数据集特征:

- 时间范围:2027年1-12月

- 字段:日期/产品类别/销售额/利润率

要求:

1. 找出销售额top3的月份,分析增长原因

2. 识别利润率低于5%的产品类别

3. 生成包含趋势图的Markdown报告

输出格式:

## 分析报告

### 关键发现

- 要点1(数据支撑)

- 要点2(对比分析)

### 可视化

趋势图描述,生成base64编码的折线图

```

* 优化点:

* 明确分析者角色

* 描述数据集特征

* 指定分析方法论

* 规范输出格式

#### LangChain 提示模板PromptTemplate介绍

* 需求

* 掌握LangChain 提示模板PromptTemplate常见用法

* 掌握提示词里面的占位符使用和预置变量

* PromptTemplate介绍

* 是LangChain中用于构建结构化提示词的组件,负责将用户输入/动态数据转换为LLM可理解的格式

* 它是一种单纯的字符模板,后续还有进阶的ChatPromptTemplate

* 主要解决

* 动态内容组装

* 避免Prompt硬编码

* PromptTemplate核心变量和方法

* template 定义具体的模板格式,其中 `{变量名}` 是占位符

* input_variables 定义模板中可以使用的变量。

* partial_variables:前置变量,可以提前定义部分变量的值,预填充进去

* format 使用 `format` 方法填充模板中的占位符,形成最终的文本

* 案例实战

* 创建PromptTemplate对象简单模版

```python

from langchain.prompts import PromptTemplate

# 定义模板

template = """

你是一位专业的{domain}顾问,请用{language}回答:

问题:{question}

回答:

"""

# 创建实例

prompt = PromptTemplate(

input_variables=["domain", "language", "question"],

template=template

)

print(prompt)

# 格式化输出

print(prompt.format(

domain="网络安全",

language="中文",

question="如何防范钓鱼攻击?"

))

```

* 自动推断变量

```python

from langchain.prompts import PromptTemplate

# 当不显式声明 input_variables 时

template = "请将以下文本翻译成{target_language}:{text}"

prompt = PromptTemplate.from_template(template)

print(prompt.input_variables) # 输出: ['target_language', 'text']

```

* 默认值设置

```python

from langchain.prompts import PromptTemplate

template = """分析用户情绪(默认分析类型:{analysis_type}):

用户输入:{user_input}

分析结果:"""

prompt_template = PromptTemplate(

input_variables=["user_input"],

template=template,

template_format="f-string", # 新增参数

partial_variables={"analysis_type": "情感极性分析"} # 固定值

)

print(prompt_template.format(user_input="这个产品太难用了"))

#====打印内部的变量======

print(prompt_template.template)

print(prompt_template.input_variables)

print(prompt_template.template_format)

print(prompt_template.input_types)

print(prompt_template.partial_variables)

```

#### PromptTemplate结合LLM案例实战

* 案例实战

```python

from langchain_openai import ChatOpenAI

from langchain_core.prompts import PromptTemplate

from langchain_core.output_parsers import StrOutputParser

#创建prompt AIGC

prompt_template = PromptTemplate(

input_variables=["product"],

template="为{product}写3个吸引人的广告语,需要面向年轻人",

)

prompt = prompt_template.invoke({"product":"小滴课堂"})

#创建模型

model = ChatOpenAI(

model_name = "qwen-plus",

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",

api_key="sk-005c3c25f6d042848b29d75f2f020f08",

temperature=0.7

)

#调用大模型

response = model.invoke(prompt)

#print(response.content)

#创建输出解析器

out_parser = StrOutputParser()

answer = out_parser.invoke(response)

print(answer)

```

#### 大模型ChatModel聊天模型和Token计算

* 什么是**ChatModel**

* 是专为**多轮对话场景**设计的大语言模型(LLM),通过理解上下文和对话逻辑,生成连贯、符合人类交互习惯的回复。

* 不仅是简单的文本生成工具,更是能处理复杂对话流程的智能系统

* 核心特点

| 特性 | 说明 | 示例场景 |

| :--------------: | :----------------------------------------------: | :----------------------------------------------------------: |

| **上下文感知** | 追踪多轮对话历史,理解指代关系(如“它”、“这个”) | 用户:“什么是量子计算?” → AI 解释 → 用户:“它有什么应用?” → AI 能正确关联“它”指量子计算 |

| **角色扮演能力** | 可设定特定角色(如客服、教师)并保持一致性 | 设定AI为“医疗助手”时,拒绝提供诊断建议,仅提供健康信息 |

| **意图识别** | 解析用户深层需求(如咨询、投诉、闲聊) | 用户:“我的订单没收到!” → AI 识别为物流投诉,优先转接人工客服 |

| **情感分析** | 识别用户情绪(积极/消极),调整回复语气 | 用户表达不满时,AI 回复:“非常抱歉给您带来不便,我们会立刻处理...” |

| **安全过滤** | 避免生成有害、偏见或敏感内容 | 用户请求生成暴力内容时,AI 拒绝并提示:“我无法协助这个请求” |

* ChatModel vs. 传统 Text Model

| **对比维度** | **ChatModel** | **传统 Text Model(如 text-davinci-003)** |

| :------------: | :------------------------------------: | :----------------------------------------: |

| **核心目标** | 多轮交互式对话 | 单次文本生成(文章、代码等) |

| **输入格式** | 结构化消息序列(System/Human/AI 角色) | 纯文本提示 |

| **上下文处理** | 自动管理对话历史 | 需手动拼接历史文本 |

| **输出控制** | 内置安全审查和格式约束 | 依赖提示词工程控制 |

| **典型应用** | 客服机器人、虚拟助手 | 内容创作、数据清洗 |

* 聊天模型(如 GPT-3.5-turbo、GPT-4)通过 **角色化消息** 实现对话控制,核心角色包括:

| 角色类型 | 标识符 | 功能定位 | 使用场景示例 |

| :-----------: | :---------: | :------------------------: | :----------------------------------------------------------: |

| **System** | `system` | 定义AI的行为准则和角色设定 | 设定AI身份、回答规则、知识范围

`("system", "你是一位医疗助手...")` |

| **User** | `user` | 代表用户的输入信息 | 用户提问、指令、反馈

`("human", "如何缓解头痛?")` |

| **Assistant** | `assistant` | 存储AI的历史回复 | 维护对话上下文、保持回答连贯性

`("ai", "建议服用布洛芬...")` |

* 参考案例OpenAI代码

```python

# 多轮对话示例

messages = [

{"role": "system", "content": "你是一个电影推荐助手"},

{"role": "user", "content": "我喜欢科幻片,推荐三部经典"},

{"role": "assistant", "content": "1.《银翼杀手2049》... 2.《星际穿越》... 3.《黑客帝国》"},

{"role": "user", "content": "第二部的主演是谁?"} # 基于上下文追问

]

response = client.chat.completions.create(

model="gpt-3.5-turbo",

messages=messages

)

print(response.choices[0].message.content)

# 输出:《星际穿越》的主演是马修·麦康纳和安妮·海瑟薇...

```

* Chat聊天多轮对话中的Token如何计算

* 在多轮对话场景下,上下文通常涵盖以下几部分:

* **用户的历史输入** :之前用户说过的话,这些内容会作为上下文的一部分,帮助模型理解当前对话的背景和意图。

* **模型的历史回复** :模型之前给出的回应,这样能让模型保持对话的连贯性和一致性。

* **系统提示** :用于设定聊天机器人的角色、目标等,引导对话的方向和风格。

* 随着上下文内容的增加,Token 数量也会相应增多。

* 多轮对话的上下文 Token 累积

* 假设每轮对话中,用户的输入和模型的输出分别对应一定数量的 Token

* 我们以每轮对话输入 50 Token、输出 100 Token 为例来计算:

* **第 1 轮** :用户的输入为 50 Token,模型的输出为 100 Token,此时上下文中的 Token 总数为 50 + 100 = 150 Token。

* **第 2 轮** :新的用户输入为 50 Token,模型新的输出为 100 Token,加上之前的历史上下文 150 Token,此时上下文中的 Token 总数为 50 + 100 + 150 = 300 Token。

* **第 3 轮** :再次新增用户输入 50 Token 和模型输出 100 Token,加上之前的历史上下文 300 Token,上下文中的 Token 总数变为 50 + 100 + 300 = 450 Token

* 上下文窗口的限制

* 每个大语言模型都有一个 “上下文窗口大小”(Context Window)的限制,

* 它决定了模型能够处理的上下文的最大 Token 数量。

* 常见的上下文窗口大小有:

* 4k Tokens :例如 OpenAI GPT - 3.5,其上下文窗口大小为 4096 个 Token。

* 8k、32k Tokens :支持长上下文的模型,如 GPT-4 等,有更大的上下文窗口,分别为 8192 个和 32768 个 Token。

#### 聊天模型ChatPromptTemplate讲解

* ChatPromptTemplate 核心概念

* 核心差异

* 支持**消息角色**(system/user/assistant)

* 天然适配聊天模型(如GPT-3.5/4)

* 可维护对话上下文

* 消息类型体系

| 消息模板类 | 对应角色 | 典型用途 |

| :-------------------------: | :--------: | :--------------: |

| SystemMessagePromptTemplate | 系统消息 | 设定AI行为规则 |

| HumanMessagePromptTemplate | 用户消息 | 接收用户输入 |

| AIMessagePromptTemplate | AI回复消息 | 记录历史响应 |

| ChatPromptTemplate | 容器模板 | 组合多个消息模板 |

* 掌握两个常见类方法

* `ChatPromptTemplate.from_template()`

* 用于创建单条消息模板,通常结合其他方法构建更复杂的对话流程。

* 适用于单一角色的消息定义(如仅系统指令或用户输入)。

* 需与其他模板组合使用,例如通过`from_messages`整合多个单模板

* `ChatPromptTemplate.from_messages()`

* 用于构建多轮对话模板,支持定义不同角色(如系统、用户、AI)的消息,并允许动态插入变量。

* 支持消息列表,每个消息可以是元组或`MessagePromptTemplate`对象。

* 角色类型包括:`system(系统指令)、human(用户输入)、ai(模型回复)`

* 可通过占位符(如`{variable}`)动态替换内容。

* 汇总对比

| 方法 | 适用场景 | 灵活性 | 代码复杂度 |

| :-------------: | :------------------------------: | :----: | :----------------: |

| `from_messages` | 多角色、多轮对话(如聊天机器人) | 高 | 较高(需定义列表) |

| `from_template` | 单角色消息模板(需组合使用) | 低 | 简单 |

* 案例实战

* 使用from_messages构建多轮对话模板

```python

from langchain_core.prompts import ChatPromptTemplate

# 定义消息列表,包含系统指令、用户输入和AI回复模板, 通过元组列表定义角色和模板,动态插入name和user_input变量

chat_template = ChatPromptTemplate.from_messages([

("system", "你是一个助手AI,名字是{name}。"),

("human", "你好,最近怎么样?"),

("ai", "我很好,谢谢!"),

("human", "{user_input}")

])

# 格式化模板并传入变量

messages = chat_template.format_messages(

name="Bob",

user_input="你最喜欢的编程语言是什么?"

)

print(messages)

# 输出结果示例:

# SystemMessage(content='你是一个助手AI,名字是Bob。')

# HumanMessage(content='你好,最近怎么样?')

# AIMessage(content='我很好,谢谢!')

# HumanMessage(content='你最喜欢的编程语言是什么?')

```

* 结合`from_template`与`from_messages`

```python

from langchain_core.prompts import (

ChatPromptTemplate,

SystemMessagePromptTemplate,

HumanMessagePromptTemplate

)

# 创建单条消息模板,通过细分模板类(如SystemMessagePromptTemplate)定义单条消息,再通过from_messages组合

system_template = SystemMessagePromptTemplate.from_template(

"你是一个{role},请用{language}回答。"

)

user_template = HumanMessagePromptTemplate.from_template("{question}")

# 组合成多轮对话模板

chat_template = ChatPromptTemplate.from_messages([

system_template,

user_template

])

# 使用示例

messages = chat_template.format_messages(

role="翻译助手",